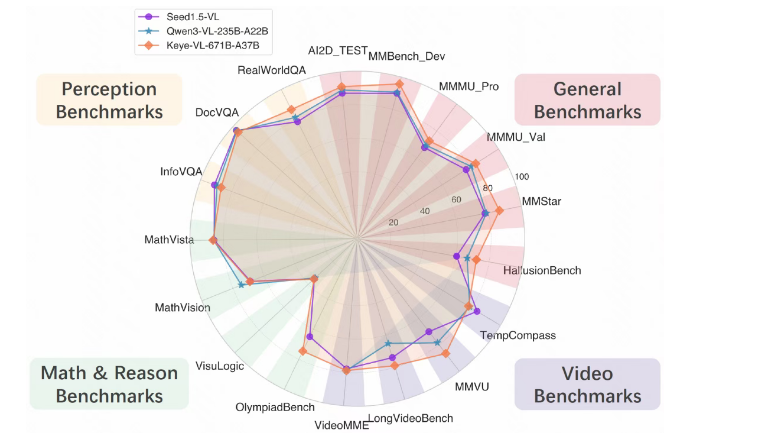

快手はこのたび、新世代のエリートマルチモーダルモデル「Keye-VL-671B-A37B」を正式に発表し、同時にコードも公開しました。このモデルは「善く見る・考える」という特徴を持ち、一般的な視覚理解、動画分析、数学的推論などの主要ベンチマークで優れた性能を発揮し、快手が人工知能分野で持つ技術力をさらに強化しています。

Keye-VL-671B-A37Bの設計理念は、より高度なマルチモーダル理解と複雑な推論を実現することです。このモデルは、基本モデルの汎用性の高い能力を基盤として、視覚認識、マルチモーダルの対応、および複雑な推論プロセスをシステム的にアップグレードし、さまざまなシナリオでの応答の正確性と安定性を向上させました。これは、日常的なアプリケーションや高難度のタスクにおいても、より正確な結果を提供できることを意味します。

技術構造に関しては、Keye-VL-671B-A37BはDeepSeek-V3-Terminusを大規模言語モデルのベースとして採用し、MLP層を通じて視覚モデルであるKeyeViTと接続されています。後者は、Keye-VL-1.5に基づいて初期化されています。モデルの事前学習プロセスは3つの段階に分けられ、システム的にマルチモーダル理解と推論能力を構築します。厳選された300Bの高品質な事前学習データにより、Keye-VL-671B-A37Bは視覚的理解の確かな基礎を確保しながら、計算コストを制御しています。

具体的なトレーニングプロセスには、視覚と言語モデルのパラメータを固定して初期対応トレーニングを行い、次にすべてのパラメータを開示して本格的な事前学習を行い、最後に高品質なデータ上で冷却トレーニングを行います。これにより、モデルの細かい感知能力が顕著に向上します。また、モデルの後処理プロセスには、監督微調整、冷スタート、強化学習などのステップが含まれ、トレーニングタスクは視覚質問応答、グラフ理解、豊富なテキストOCRなど多岐にわたります。

快手は、今後Keye-VLが基礎モデルの能力を継続的に向上させ、さらにマルチモーダルエージェントの能力を統合し、「ツールを使える」「複雑な問題を解決できる」スマートな形態へと進化していくことを目指しています。モデルの複数ラウンドのツール呼び出し能力は強化され、実際のタスクにおいて外部ツールを自主的に呼び出して、複雑な検索、推論、情報統合を実行できるようになります。また、Keye-VLは「画像で考える」「動画で考える」などの重要な方向性において深く探求し、モデルが画像や動画を理解するだけでなく、それらのコンテンツを中心に深い思考と連鎖的な推論を行うことができるようになります。

基礎能力とエージェント能力の二つの駆動力によって、快手のKeye-VLの目標は、マルチモーダルインテリジェンスの上限を常に拡張し、より汎用的で信頼性が高く、推論能力が強い次の世代のマルチモーダルシステムに向かって進むことです。この革新は、マルチモーダルAIの発展に新たな機会と課題をもたらすでしょう。