NVIDIA 最近推出了一種新方法 ——ToolOrchestra,旨在提升 AI 系統選擇合適模型和工具的能力,避免傳統的單一大型模型依賴。該方法通過訓練一個名爲 Orchestrator-8B 的小型語言模型,作爲多工具使用代理的 “大腦”,實現更高效的任務處理。

目前大多數 AI 代理使用單一大型模型,例如 GPT-5,根據提示選擇工具並完成任務。然而,研究發現,這種方法容易導致模型在決策時偏向於使用自身,造成資源浪費。爲此,ToolOrchestra 設計了一種專門的控制模型 Orchestrator-8B,利用強化學習來優化工具選擇。

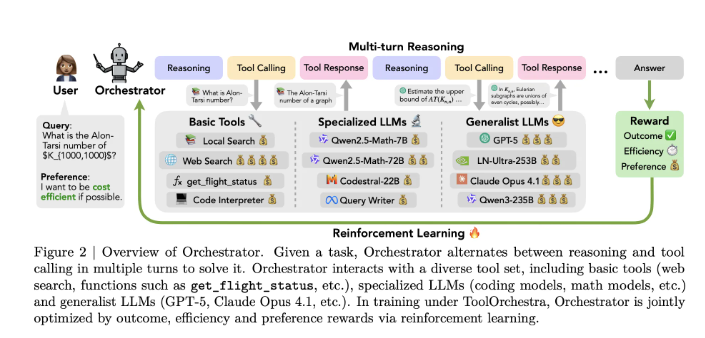

Orchestrator-8B 是一個具有8億參數的解碼器,僅使用 Transformer 結構,通過微調 Qwen3-8B 模型而成。其工作流程分爲三個主要步驟:首先,模型解析用戶指令及可選的自然語言偏好,例如優先考慮低延遲或避免網絡搜索;接着,生成推理過程並計劃行動;最後,從可用工具中選擇,並以統一的 JSON 格式發出工具調用。這一過程會持續進行,直到任務完成或達到50個步驟的上限。

ToolOrchestra 的強化學習設計包括多個獎勵機制,以確保任務的高效完成。具體來說,模型的獎勵由三個部分組成:任務成功的二元獎勵、效率獎勵(針對成本和時間)以及用戶偏好獎勵。這些因素結合起來,幫助優化策略,使 Orchestrator-8B 在選擇和使用工具時更爲靈活。

在一系列基準測試中,Orchestrator-8B 表現優異。例如,在 “人類最後的考試” 中,其準確率達到37.1%,高於 GPT-5的35.1%。在效率方面,Orchestrator-8B 的平均成本僅爲0.092美元,時間爲8.2分鐘,遠低於 GPT-5的0.302美元和19.8分鐘。這表明,Orchestrator-8B 在資源利用和任務處理上表現更佳,適合關注效率和成本的團隊。

NVIDIA 的 ToolOrchestra 爲複合 AI 系統的構建邁出了重要一步,通過訓練特定的路由策略,顯著提升了任務處理的效率和準確性。

論文:https://arxiv.org/pdf/2511.21689

劃重點:

🧠 Orchestrator-8B 是 NVIDIA 推出的一個8億參數的小型控制模型,旨在優化多工具使用的效率。

💡 通過強化學習,Orchestrator-8B 能夠更靈活地選擇和調用工具,減少資源浪費。

📊 在多個基準測試中,Orchestrator-8B 在準確性和效率方面均優於傳統的大型模型,如 GPT-5。