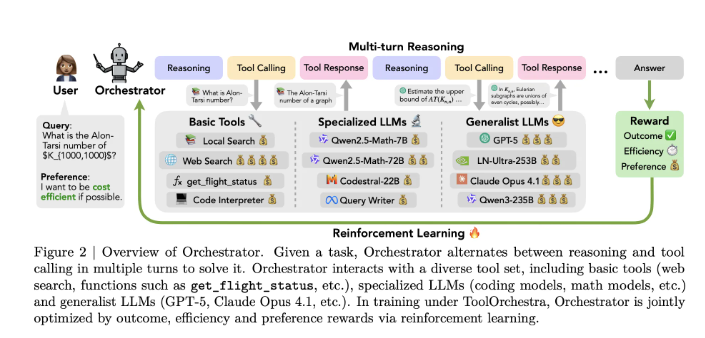

NVIDIA は最近、AI システムが適切なモデルやツールを選択する能力を向上させるための新しい方法「ToolOrchestra」を発表しました。従来の単一の大規模モデルに依存するのではなく、これによりより効率的なタスク処理が可能になります。この方法では、多ツール使用エージェントの「脳」として機能する小さな言語モデル「Orchestrator-8B」をトレーニングし、タスク処理をより効率的にしています。

現在の大多数のAIエージェントは、GPT-5などの大規模モデルを使用しており、プロンプトに応じてツールを選択しタスクを完了します。しかし、研究によると、この方法はモデルが自身を優先的に選ぶ傾向があり、リソースの無駄遣いにつながる可能性があります。そこで、ToolOrchestraは専用の制御モデルであるOrchestrator-8Bを開発し、強化学習を活用してツール選択を最適化しました。

Orchestrator-8Bは80億パラメータを持つデコーダーであり、Transformer構造のみを使用し、Qwen3-8Bモデルを微調整して作成されました。その作業フローは3つの主要なステップからなります。まず、モデルはユーザーの指示およびオプションの自然言語の好み(例えば低遅延を優先するか、ネットワーク検索を避けるなど)を解析します。次に、推論プロセスを生成し、行動計画を立てます。最後に、利用可能なツールから選択し、統一されたJSON形式でツール呼び出しを行います。このプロセスはタスクが完了するまでまたは50ステップの上限に達するまで継続されます。

ToolOrchestraの強化学習設計には、タスクの効率的な完了を確保するための複数の報酬メカニズムが含まれています。具体的には、モデルの報酬は3つの部分から構成されています: タスク成功の二値報酬、効率報酬(コストと時間に対して)、およびユーザーの好み報酬です。これらの要素を組み合わせることで、Orchestrator-8Bがツールを選択・使用する際の柔軟性が高まります。

さまざまなベンチマークテストにおいて、Orchestrator-8Bは優れた性能を示しました。例えば、「人類最後の試験」において、正確率は37.1%で、GPT-5の35.1%を上回りました。効率面では、Orchestrator-8Bの平均コストは0.092ドルで、時間が8.2分で、これはGPT-5の0.302ドルと19.8分よりもはるかに低くなっています。これは、Orchestrator-8Bがリソースの利用やタスク処理において優れていることを示しており、効率とコストを重視するチームにとって適しています。

NVIDIA の ToolOrchestra は、複合的な AI システムの構築に重要な一歩を踏み出しました。特定のルーティング戦略をトレーニングすることで、タスク処理の効率と正確性を顕著に向上させました。

論文:https://arxiv.org/pdf/2511.21689

ポイント:

🧠 Orchestrator-8B は NVIDIA が開発した 8 億パラメータの小型制御モデルで、マルチツール使用の効率を最適化することを目的としています。

💡 強化学習を通じて、Orchestrator-8B はツールをより柔軟に選択・呼び出すことができ、リソースの無駄を減らします。

📊 複数のベンチマークテストにおいて、Orchestrator-8B は伝統的な大規模モデルである GPT-5 よりも正確性と効率の両面で優れています。