據國外媒體報道,蘋果研究團隊近日發佈了適配版的SlowFast-LLaVA模型,該模型在長視頻分析理解任務上表現出色,其性能甚至超越了參數規模更大的模型。這項突破爲長視頻內容分析提供了高效的全新解決方案。

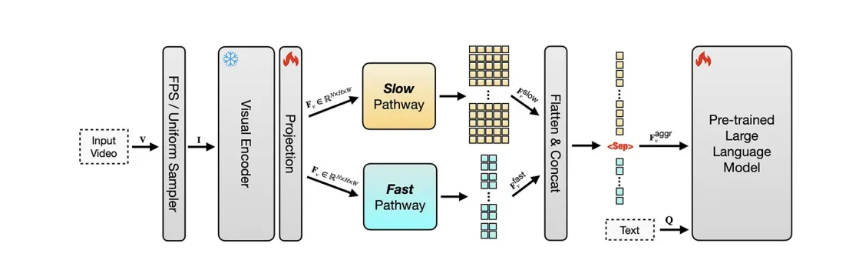

該模型的核心優勢在於其雙流架構,這一設計有效解決了傳統逐幀處理模式下的信息冗餘和上下文窗口溢出問題。慢流(Slow) 以低幀率捕捉場景中的靜態細節和背景信息,而快流(Fast) 則以高幀率追蹤動作的快速變化。這種協同工作模式極大地優化了視頻處理效率。

在長視頻基準測試中,SlowFast-LLaVA展現了卓越性能。其10億、30億和70億參數版本均取得了優異成績。例如,參數僅爲10億的模型在LongVideoBench的General VideoQA任務中獲得了56.6分,而70億參數版本在Long-Form Video Understanding任務中更是達到了71.5分的高分。除了視頻理解,該模型在知識推理和OCR等圖像理解任務上同樣表現出色。

儘管該模型表現出衆,目前仍存在一定侷限性,例如輸入幀長限制在128幀,可能導致關鍵信息的遺漏。蘋果團隊表示,未來將繼續探索內存優化技術以提升模型性能。

SlowFast-LLaVA基於公開數據集訓練並已開源,爲整個AI社區在長視頻理解領域提供了新的思路和高效工具。