隨着AI技術的飛速發展,大模型在圖像放大領域的表現已令人驚歎,高清化低分辨率圖片早已不是難事。然而,在視頻超分辨率(RealVSR)領域,如何在保持幀間流暢性的同時大幅提升清晰度,一直是技術難題。近日,由香港理工大學與OPPO研究院聯合研發的DLoRAL框架橫空出世,以其創新的雙LoRA架構和高效的單步生成能力,爲視頻高清化提供了開源解決方案,引發業界廣泛關注。以下,AIbase爲您獨家解讀這一突破性技術的亮點與潛力。

項目地址:https://github.com/yjsunnn/DLoRAL

創新雙LoRA架構,兼顧時間與空間

DLoRAL(Dual LoRA Learning)框架基於預訓練的擴散模型(Stable Diffusion V2.1),通過獨特的雙LoRA架構實現了視頻超分辨率的革命性突破。其核心在於兩個專門設計的LoRA模塊:

CLoRA:專注於視頻幀之間的時間一致性(Temporal Consistency)。通過提取低質量輸入視頻中的時序特徵,CLoRA確保相鄰幀之間過渡自然,避免了傳統方法中常見的閃爍或跳躍現象。

DLoRA:負責增強視頻的空間細節(Spatial Details)。DLoRA通過優化高頻信息,顯著提升畫面的清晰度和細節表現,讓低分辨率視頻煥發出高清質感。

這種雙LoRA設計將時間一致性與空間細節增強兩大目標解耦,通過輕量化的模塊嵌入預訓練擴散模型,既降低了計算成本,又提升了生成效果。

雙階段訓練策略,效率與質量雙贏

DLoRAL的訓練過程採用了創新的雙階段策略,分爲一致性階段和增強階段,交替優化以實現最佳性能:

一致性階段:通過CLoRA模塊和CrossFrame Retrieval(CFR)模塊,結合一致性相關損失函數,優化視頻幀間的時序連貫性。這一階段確保生成的視頻在動態場景下也能保持流暢。

增強階段:凍結CLoRA和CFR模塊,專注於訓練DLoRA,利用分類器分數蒸餾(CSD)等技術進一步提升高頻細節,讓畫面更加銳利清晰。

這種交替訓練的方式讓DLoRAL能夠專注於不同目標的優化,最終在推理階段通過單步生成,將CLoRA和DLoRA融合到凍結的擴散UNet中,實現高效的高質量視頻輸出。相比傳統多步迭代的超分辨率方法,DLoRAL的推理速度提升約10倍,展現了驚人的效率優勢。

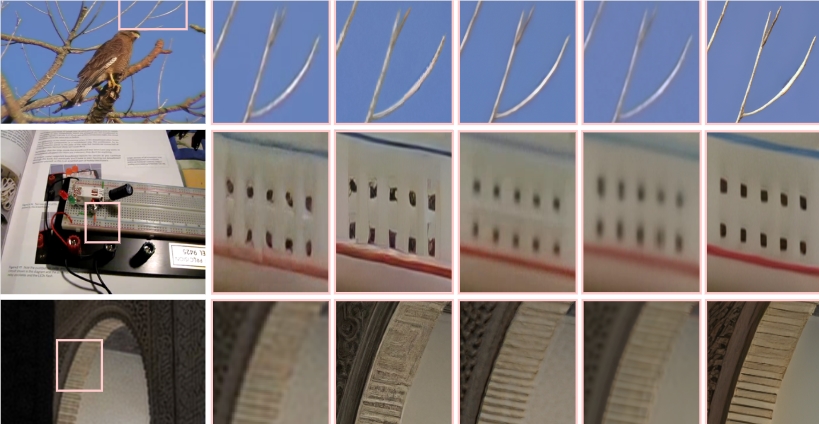

開源賦能,助力學術與產業

DLoRAL的開源發佈爲學術界和產業界帶來了福音。其代碼、訓練數據以及預訓練模型已於2025年6月24日在GitHub上公開,項目頁面還提供了詳細的2分鐘講解視頻和豐富的視覺效果展示。DLoRAL不僅在視覺質量上超越了現有的RealVSR方法,還在PSNR和LPIPS等指標上展現了優異性能。然而,由於繼承了Stable Diffusion的8倍下采樣變分自編碼器(VAE),DLoRAL在恢復極細小文本等細節時仍存在一定侷限性,未來改進空間值得期待。

視頻超分辨率的未來風向

DLoRAL的出現標誌着視頻超分辨率技術邁向了一個新階段。其單步生成能力和開源特性爲開發者提供了低成本、高效率的解決方案,極大地降低了視頻高清化的技術門檻。AIbase認爲,隨着更多研究者和企業基於DLoRAL進行二次開發,視頻處理領域或將迎來更多創新應用,例如實時視頻增強、影視後期製作優化等。