OpenAI は、GPT-5を基盤としたスマートなセキュリティ研究アシスタント「Aardvark」の新製品を発表しました。この製品はソフトウェアのセキュリティを向上させるために設計されています。毎年何万もの新しい脆弱性が登場する中、開発者やセキュリティチームはこれらの脆弱性を発見し修正する大きな課題に直面しています。Aardvarkは、開発者とセキュリティチームがより効率的にセキュリティ上の脆弱性を発見・修正できるようにすることを目的としています。

Aardvarkは継続的にソースコードのライブラリを分析し、脆弱性を特定し、利用可能性を評価し、優先順位をつけて修復案を提示します。従来のプログラム分析方法とは異なり、Aardvarkは大規模言語モデル(LLM)の推論能力とツールの使用能力を利用して、人間のセキュリティ研究者のようにコードを読み、分析し、テストを記述および実行します。

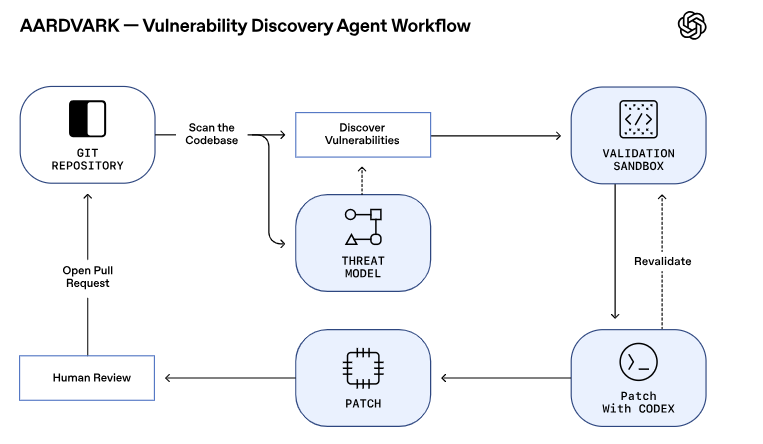

Aardvarkの作業プロセスには複数の段階があります。まず、プロジェクトのセキュリティ目標と設計を反映した脅威モデルを構築するために、全体のコードベースを分析します。次に、新しいコードの提出時、Aardvarkは変更点をチェックして潜在的な脆弱性を探します。初めてコードベースに接続するとき、過去の履歴をスキャンして既存の問題を識別します。その後、Aardvarkは隔離されたサンドボックス環境で潜在的な脆弱性の利用可能性を検証し、取ったステップを詳細に説明します。最後に、OpenAI Codexと統合され、発見された脆弱性に対する修復パッチを生成し、開発者が簡単に人間による審査とワンクリックでの修復を行うことを支援します。

過去数か月のテストでは、AardvarkはOpenAIの内部コードベースおよび一部の外部パートナーのプロジェクトで動作し、多くの重要な脆弱性を発見し、OpenAIのセキュリティ防御にポジティブな影響を与えました。その「ゴールド」コードベースでのベンチマークテストでは、既知および合成的に導入された脆弱性の92%を識別し、その効率性と実用性を証明しました。

また、Aardvarkはオープンソースプロジェクトにも応用され、多数の脆弱性を発見し、責任ある公開を行いました。現在、OpenAIは一部の非商業的なオープンソースプロジェクトに対して無料スキャンサービスを提供する計画を立てており、オープンソースソフトウェアエコシステムの安全性を高める endeavour を行っています。

ソフトウェアがあらゆる業界の基盤となるにつれて、ソフトウェアの脆弱性のリスクもますます顕在化しています。Aardvarkの登場は、防御者中心の新たなモードを示しており、コードの進化過程においてシステムを継続的に保護できます。OpenAIはAardvarkのプライベートテストフェーズを開始し、関心のあるパートナーを招待して、さらに性能を検証しています。

公式ブログ:https://openai.com/index/introducing-aardvark/

ポイント:

🌟 AardvarkはOpenAIがリリースしたスマートなセキュリティ研究アシスタントであり、開発者がソフトウェアの脆弱性を発見および修正するのを支援します。

🔍 それはコードベースを分析し、脅威モデルを構築し、脆弱性の利用可能性を検証することで、効率的な脆弱性検出を実現します。

🤝 OpenAIは非商業的なオープンソースプロジェクトに対して無料スキャンサービスを提供する予定で、全体のオープンソースエコシステムのセキュリティを向上させることを目指しています。