人工知能による画像編集および生成の分野において、新たな画期的な技術が注目を集めています。ビットテイションと香港中文大学、香港科技大学、香港大学が共同で開発したDreamOmni2システムは、正式にオープンソース化され、画像編集・生成技術の最新の進展を示しています。

DreamOmni2の登場により、人工知能が画像処理における指示に従う能力を向上させ、本格的なマルチモーダル指示理解を実現しました。このシステムは、テキスト指示と参照画像の両方を同時に理解でき、以前のモデルが抽象的概念(スタイル、素材、照明など)を処理する際の限界を大幅に改善しました。ユーザーとAIとのインタラクションがより自然になり、自分自身の意図を理解してくれるパートナーと会話しているように感じられます。

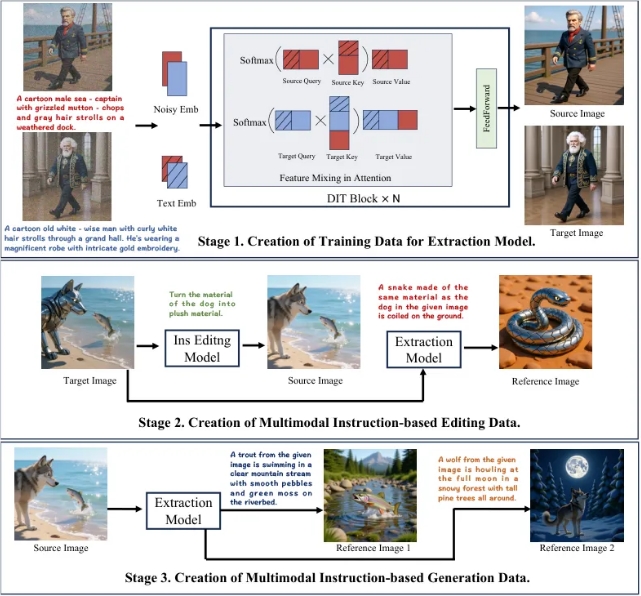

複雑なテキストや画像指示をAIに理解させるため、DreamOmni2の研究チームは独自の三段階プロセスを開発しました。まず、AIは画像から特定の要素や抽象的属性を正確に抽出できるようにトレーニングされます。次に、抽出モデルを使用してマルチモーダル指示編集データを生成し、ソース画像、指示、参照画像、およびターゲット画像を含むトレーニングサンプルを作成します。最後に、さらなる抽出と組み合わせによって、より多くの参照画像を構築し、豊富なマルチモーダル指示生成データセットを作成します。これらのステップは、システムの高品質なトレーニングの基盤となりました。

モデルアーキテクチャにおいて、DreamOmni2はインデックス符号化と位置符号化オフセットの提案を行い、複数の入力画像を正確に認識できるようにしています。また、視覚言語モデル(VLM)を導入することで、ユーザーの指示とモデルの理解の間にあるギャップを効果的に解決しました。この革新的な設計により、システムの指示処理の正確性が向上し、ユーザーの真の意図をよりよく理解できるようになりました。

テストの結果、DreamOmni2はマルチモーダル指示編集タスクにおいて、すべての比較対象となるオープンソースモデルを上回り、トップクラスの商用モデルに近づいています。従来の商用モデルと比べて、DreamOmni2は複雑な指示を処理する際、より高い正確性と一貫性を提供し、不要な変更や画像の欠陥を回避できます。