微軟悄然開源了一枚“黑馬級”實時語音模型:VibeVoice-Realtime-0.5B。這可能是目前全球延遲最低、表現最接近真人的開源文本轉語音(TTS)模型之一,話還沒說完,聲音就已經開始了!

極致實時:300ms就能開口說話

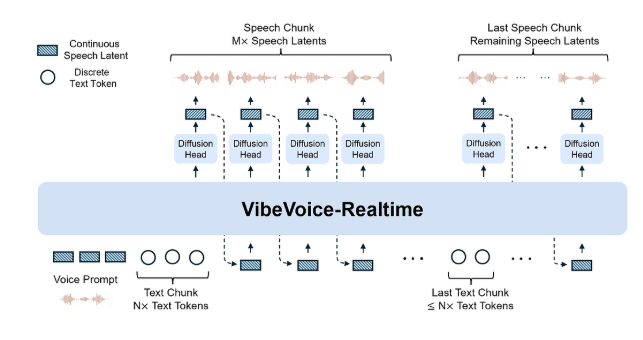

VibeVoice-Realtime-0.5B最硬核的能力是“幾乎零延遲”。從輸入文本到第一聲發聲平均僅需300毫秒,遠低於傳統TTS動輒1-3秒的起音時間。實際體驗就像真人對話:你打字的同時,對方已經開始迴應,完全沒有“等我生成完再播”的卡頓感。

長文本都不怕:一次生成90分鐘流暢語音

別看模型只有0.5B參數,它卻能一次性生成長達90分鐘的超長音頻,且全程不降速、不跑調、不重複,語調起伏自然得像專業播音員。目前已在HuggingFace實測通過,網友直接拿整本《三體》第一章喂進去,完整朗讀下來毫無破音。

多角色對話神器:4人播客也能完美還原

模型原生支持最多4個角色同時對話,每個角色都能保持獨立且穩定的聲線、語速和語氣。比如模擬播客訪談場景:主持人沉穩、嘉賓A激動、嘉賓B幽默、嘉賓C略帶歉意,四人輪流發言時互不串音,情緒切換絲滑,堪稱“AI配音組團天花板”。

情緒表達拉滿:自動識別憤怒、激動、歉意

得益於內置的情感感知模塊,VibeVoice能根據文本語義自動添加對應情緒:

- 看到“對不起”會自然帶上歉意語氣

- 遇到“太棒了!”會瞬間上揚興奮

- 甚至一句“我很生氣”都會壓低聲線、加快語速

完全不需要手動標註情緒標籤,開箱即用。

中英文雙語,中文雖有進步但仍有提升空間

模型支持中英文混讀,英文表現已接近商用級別,中文發音準確、自然度極高,但部分多音字、輕聲詞處理仍有優化空間。官方表示後續會推出專門的中文精調版本。

輕量級設計:輕鬆塞進手機和邊緣設備

僅0.5B參數,推理時顯存佔用不到2GB,在普通筆記本上就能跑滿實時速度。開發者已經將其快速集成到本地AI助手、閱讀App、實時同傳工具中,未來有望成爲“AI本地語音標配”。

目前VibeVoice-Realtime-0.5B已在HuggingFace和GitHub完全開源(MIT協議),支持商用。社區已出現大量Demo:有人用它做了“邊打字邊讀”的微信語音輸入神器,有人直接接在大模型後面,實現真正的全鏈路實時語音對話。

AIbase報道點評:

在開源圈還在卷10B+參數的巨型TTS時,微軟用一個0.5B的小模型直接把“實時、自然、長文本、多角色”全部幹到接近商用級別。這波操作,堪稱“降維打擊”。接下來,就看國產大廠如何接招了。

項目地址:https://microsoft.github.io/VibeVoice/