Maya Research 最近發佈了 Maya1,這是一個具有30億參數的文本轉語音模型。它能夠將文本和簡短描述轉化爲可控、富有表現力的語音,並能在單個 GPU 上實時運行。Maya1的核心功能在於能夠捕捉真實人類情感以及精確的聲音設計。

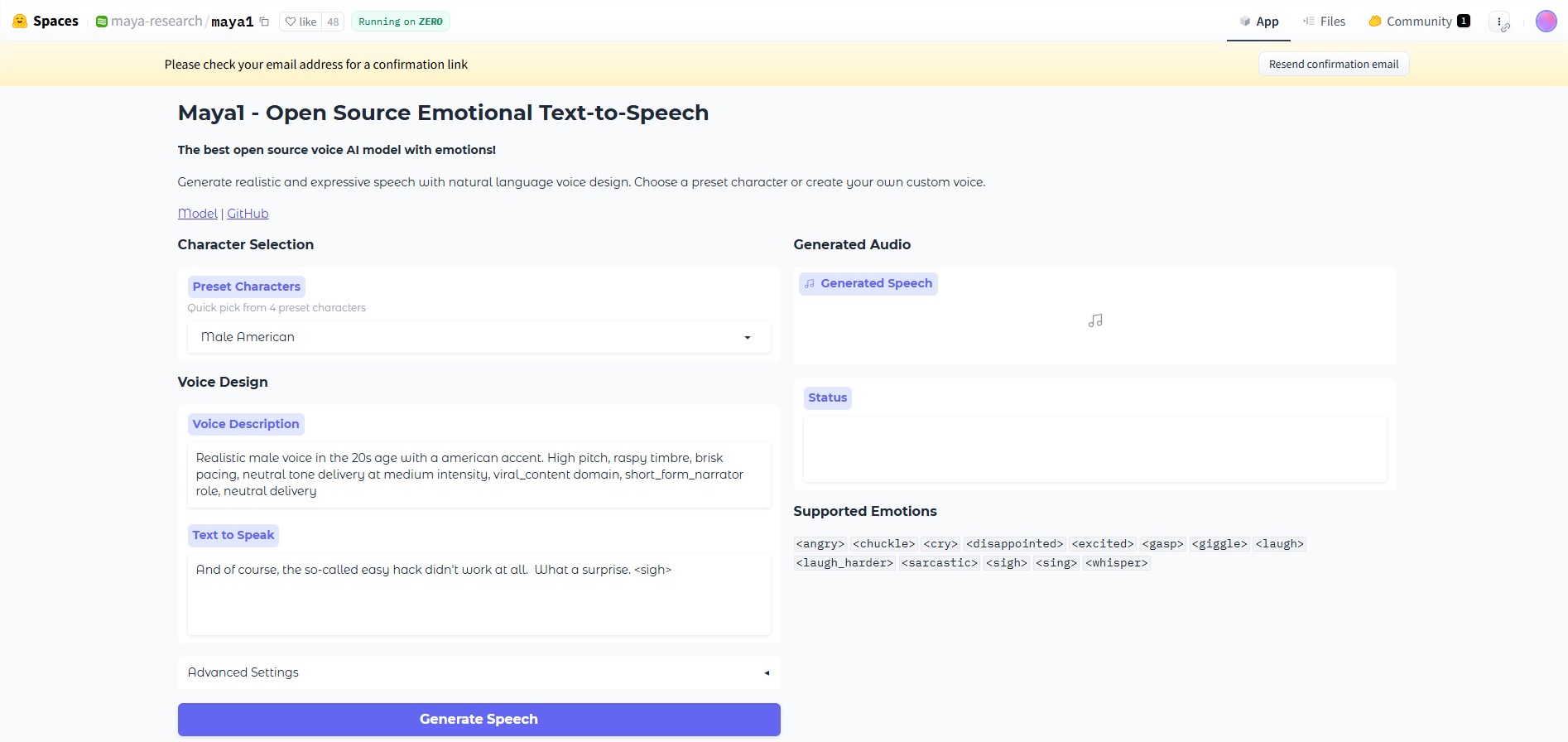

Maya1的操作界面有兩個輸入:自然語言語音描述和需要朗讀的文本。例如,用戶可以輸入 “20多歲女性,英式口音,充滿活力,清晰的發音” 或 “惡魔角色,男性聲音,低音調,沙啞的音色,慢節奏”。模型會結合這兩種信號生成符合內容和描述風格的音頻。此外,用戶還可以在文本中插入情感標籤,如 < 笑 >、< 嘆氣 >、< 低語 > 等,超過20種情感供選擇。

Maya1輸出的音頻爲24kHz 單聲道,並支持實時流媒體,這使其非常適合用於助手、互動代理、遊戲、播客及直播內容。Maya Research 團隊聲稱,該模型的性能超過了許多頂級的專有系統,同時完全開源,遵循 Apache2.0許可證。

在架構上,Maya1是一個解碼器僅有的變換器,採用類似 Llama 的結構。它不直接預測原始波形,而是通過名爲 SNAC 的神經音頻編碼器預測編碼。整個生成流程包括文本處理、編碼生成和音頻解碼,能夠有效提高生成效率並便於擴展。

Maya1的訓練數據來自互聯網規模的英語語音語料庫,旨在學習廣泛的聲學覆蓋和自然的連貫性。隨後,它還在一個經過精心挑選的專有數據集上進行了微調,該數據集包含經人類驗證的語音描述和多種情感標籤。

爲了在單個 GPU 上進行推理和部署,Maya1推薦使用16GB 及以上的顯存卡,例如 A100、H100或 RTX4090。此外,Maya Research 團隊還提供了一系列工具和腳本,方便用戶進行實時音頻生成和流媒體支持。

huggingface:https://huggingface.co/spaces/maya-research/maya1

劃重點:

🎤 Maya1是一個30億參數的開源文本轉語音模型,能夠實時生成富有表現力的音頻。

💡 該模型結合自然語言描述和文本輸入,支持多種情感標籤,提升語音表現力。

🚀 Maya1可在單個 GPU 上運行,並提供多種工具以支持高效的推理和部署。