幻方量化於12月26日晚發佈全新一代大模型DeepSeek-V3,展現出驚人的技術突破。這款採用MoE(混合專家)架構的模型不僅在性能上媲美頂級閉源模型,其低成本高效率的特點更是引發業界關注。

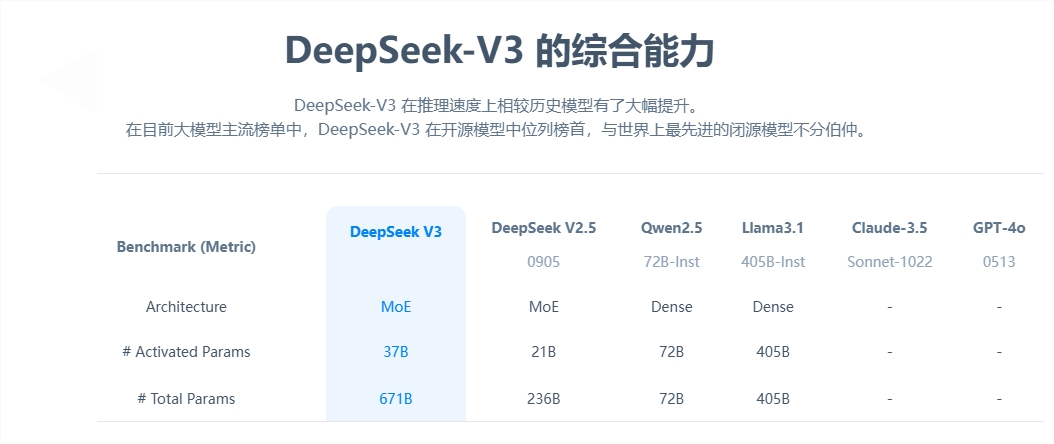

從核心參數來看,DeepSeek-V3擁有6710億參數,其中激活參數爲370億,在14.8萬億token的數據規模上完成預訓練。相比前代產品,新模型的生成速度提升了3倍,每秒可處理60個token,顯著提升了實際應用效率。

在性能評測方面,DeepSeek-V3展現出卓越實力。它不僅超越了Qwen2.5-72B和Llama-3.1-405B等知名開源模型,更在多項測試中與GPT-4和Claude-3.5-Sonnet不相上下。特別是在數學能力測試中,該模型以優異成績超越了所有現有開源和閉源模型。

最引人注目的是DeepSeek-V3的低成本優勢。根據開源論文披露,按每GPU小時2美元計算,模型全部訓練成本僅爲557.6萬美元。這一突破性成果得益於算法、框架和硬件的協同優化。OpenAI聯合創始人Karpathy對此給予高度評價,指出DeepSeek-V3僅用280萬GPU小時就達到了超越Llama3的性能,計算效率提升了約11倍。

在商業化方面,DeepSeek-V3的API服務定價雖較上一代上調,但仍保持較高性價比。新版本定價爲每百萬輸入tokens0.5-2元,輸出tokens8元,總成本約爲10元人民幣。相比之下,GPT-4的同等服務價格約爲140元人民幣,價格差距顯著。

作爲一款全面開源的大模型,DeepSeek-V3的發佈不僅展示了中國AI技術的進步,更爲開發者和企業提供了一個高性能、低成本的AI解決方案。