Hunyuan-A13B 是一個由騰訊最新開源的大語言模型,它以創新的設計理念,在相對較小的活躍參數規模下,實現了強大的性能表現,特別適用於資源受限的環境。

這款模型採用了細粒度 MoE(Mixture-of-Experts)架構,擁有130億活躍參數,但總參數量高達800億。這種設計讓它在保持高效和可擴展性的同時,能夠提供前沿的推理能力和通用應用支持。

Hunyuan-A13B 的核心功能亮點包括:

支持快慢思維的混合推理模式:這種獨特的推理機制讓模型能夠根據任務需求靈活調整思考深度,提升處理複雜問題的效率。

原生256K 超長上下文理解能力:這意味着模型可以處理極長的文本輸入,使其在需要大量背景信息的任務中表現出色。

在智能體任務上的卓越表現:Hunyuan-A13B 在執行各類智能體(Agent)相關任務時展現出強大的能力。

爲了實現高效推理,Hunyuan-A13B 採用了 Grouped Query Attention (GQA) 技術,並支持多種量化格式。目前,該模型已開源預訓練、指令微調、FP8和 INT4量化版本,方便開發者使用。

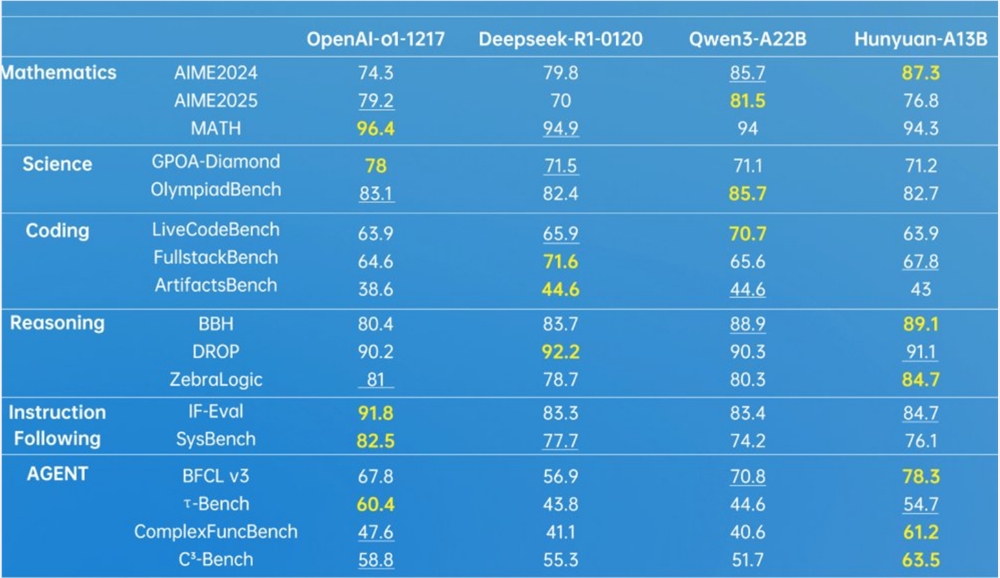

在多項基準測試中,Hunyuan-A13B 都展現出強大的競爭力,尤其是在數學、科學、編碼、推理和智能體領域。

騰訊爲開發者提供了全面的支持,包括使用 Hugging Face Transformers 進行交互和模型訓練的詳細指南。同時,對於模型部署,Hunyuan-A13B 也提供了通過 TensorRT-LLM、vLLM 和 SGLang 的支持,並提供了預構建的 Docker 鏡像和量化模型部署方案,大大簡化了部署流程。

Hunyuan-A13B 的開源,無疑爲大模型在資源受限環境下的應用開闢了新的可能性,也爲 AI 社區帶來了新的創新動力。

開源地址:https://huggingface.co/tencent/Hunyuan-A13B-Instruct

github:https://github.com/Tencent-Hunyuan/Hunyuan-A13B?tab=readme-ov-file