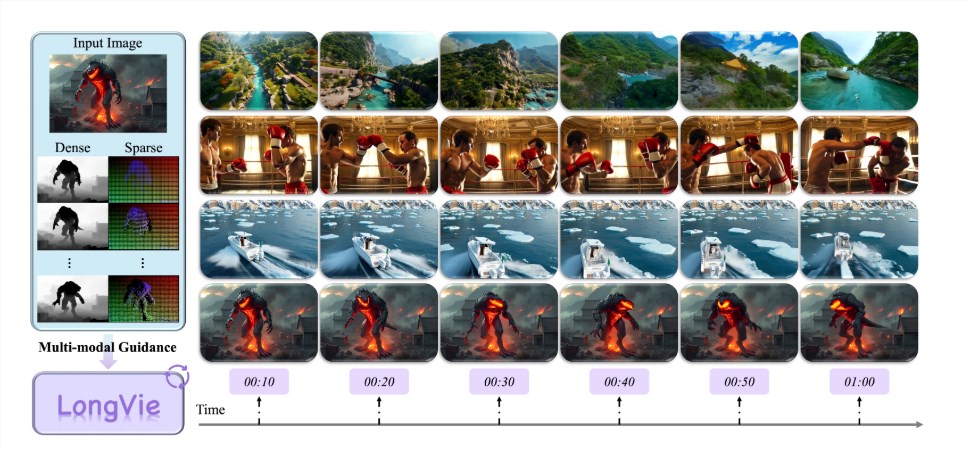

過去2年間、動画生成技術は驚くべき進歩を遂げ、特に短い動画の作成においては大きな進展がありました。しかし、1分を超える高品質でスタイルが統一された長動画の作成は依然として大きな課題です。これに対して、上海人工知能研究所は南京大学、復旦大学、南洋理工大学 S-Lab および NVIDIA などの機関と連携し、LongVie フレームワークを共同で発表しました。このフレームワークは、この分野における核心的な問題を体系的に解決しています。

LongVie の目的は、長動画の生成をよりコントロール可能で一貫性を持たせることです。研究チームは、従来の動画生成モデルが長動画を処理する際には時系列の不一致や視覚的な劣化などの問題に直面していることを発見しました。前者は、画像の細部や内容が不連続になる現象を指し、後者は動画の長さが増すにつれて画像の色や解像度が低下する現象を意味します。

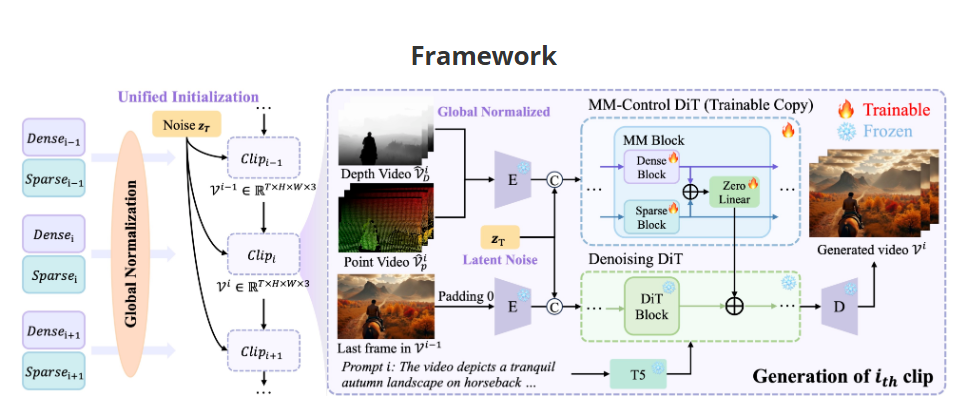

これらの問題を解決するために、LongVie は「制御信号」と「初期ノイズ」の2つの観点からアプローチしました。まず、チームは「制御信号のグローバル正規化」戦略を提案しました。これは、動画を生成する際に単一のセグメント内で正規化を行うのではなく、全体のセグメントの制御信号を統一することで、セグメント間の連続性を向上させるものです。次に、「統一ノイズ初期化」戦略を導入し、各セグメントが同じ初期ノイズを共有することによって、元々の視覚的な漂移を減らします。

視覚的な劣化の問題に対処するため、LongVie は多モードの詳細な制御方法を採用しました。単一モードの制御では安定した制約を提供できないことが多く、LongVie は密な制御信号(例:深度マップ)と疎な制御信号(例:キーポイント)を組み合わせ、劣化感知トレーニング戦略を導入することで、モデルが長動画を処理する際にも高い画質と詳細を維持できるようにしています。

さらに、LongVie は LongVGenBench をリリースしました。これは、制御可能な超長動画生成専用のベンチマークデータセットであり、1分を超える高解像度の動画が100本含まれており、この分野の研究と評価を推進することを目的としています。定量的指標およびユーザー評価の結果に基づき、LongVie は多くの評価項目で既存技術を上回り、ユーザーからの高い評価を得ており、SOTA(最高度の技術)レベルに達しています。

LongVie フレームワークの登場により、超長動画の生成は新しい時代を迎えることになります。クリエイターたちは、より大きな自由度の中で自分のアイデアを実現できるようになります。

プロジェクトのURL:https://vchitect.github.io/LongVie-project/