谷歌 DeepMind 首次進行了關於最常見的惡意 AI 應用的研究,結果顯示生成虛假政治家和名人的人工智能(AI)“Deepfakes” 比用 AI 協助網絡攻擊的嘗試更爲普遍。這一研究是谷歌 AI 部門 DeepMind 和谷歌旗下的研發單位 Jigsaw 合作的,目的是量化生成 AI 工具的風險,這些工具已被全球最大的科技公司推向市場以尋求鉅額利潤。

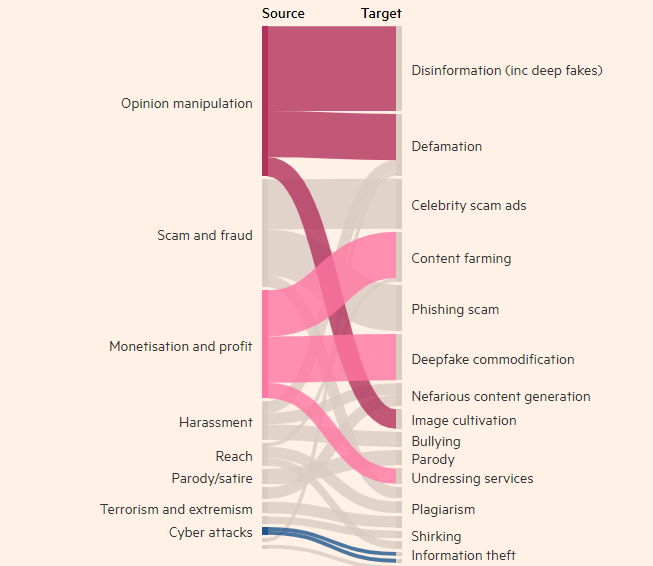

與技術相關的不良行爲者的動機

研究發現,製作真實但虛假的人物圖像、視頻和音頻的行爲幾乎是濫用生成 AI 工具的次數最多的一種,比其他次高的使用文本工具(例如聊天機器人)僞造信息的方式高出近兩倍。濫用生成 AI 的最常見目標是影響公衆輿論,這佔用了27% 的使用情況,引發了對 Deepfakes 如何影響今年全球選舉的擔憂。

近幾個月來,英國首相 Rishi Sunak 和其他全球領袖的 Deepfakes 出現在 TikTok、X 和 Instagram 上。英國選民將在下週的大選中投票。儘管社交媒體平臺努力標註或刪除此類內容,但人們可能不會認識到這是虛假的,而內容的傳播可能會影響選民的投票。DeepMind 的研究人員分析了大約200起濫用行爲,涉及社交媒體平臺 X 和 Reddit,以及在線博客和媒體報道濫用行爲的情況。

研究發現,濫用 AI 生成產品(如 OpenAI 的 ChatGPT 和谷歌的 Gemini)的第二大動機是賺錢,無論是提供創建 Deepfakes 的服務,還是使用生成 AI 創建大量內容,例如虛假新聞文章。研究發現,大多數濫用行爲使用易於獲得的工具,“需要最少的技術專業知識”,這意味着更多的不良行爲者可以濫用生成 AI。

DeepMind 的研究將影響其改進評估模型的安全性,並希望這也會影響其競爭對手和其他利益相關者如何看待 “危害的表現”。

劃重點:

- 👉 DeepMind 的研究發現 Deepfakes 是濫用人工智能應用的首要問題。

- 👉 最常見的濫用生成 AI 工具的目的是影響公衆輿論,佔使用情況的27%。

- 👉 濫用生成 AI 的第二大動機是賺錢,主要包括提供 Deepfakes 服務和虛假新聞的創建。