字節跳動剛剛發佈了其最新的多模態大語言模型 Vidi2,一個擁有120億參數、專用於視頻理解的AI模型。該模型能夠處理數小時長的原始素材,理解其中的故事脈絡,並根據簡單提示生成完整的TikTok短視頻或電影片段,被視爲對現有視頻編輯行業的重大顛覆。

突破:精細時空定位(STG)

Vidi2的關鍵在於其視頻理解能力。新模型新增了精細的時空定位(STG)功能,能夠同時識別視頻中的時間戳和目標對象的邊界框。給定文本查詢,Vidi2不僅能找到對應的時間段,還能在這些時間範圍內準確標記出具體物體的位置。

在技術細節上:

時空定位:模型返回“管道”(時間索引邊界框),以一秒粒度跟蹤指定對象和人物,直接支持編輯,例如在人羣中跟蹤特定人物。

技術架構:Vidi2升級使用 Gemma-3 作爲主幹網絡,並輔以重新設計的自適應標記壓縮技術,確保在處理長視頻時保持效率而不丟失關鍵細節。

性能領跑:超長視頻理解優勢明顯

Vidi2在行業基準測試中表現卓越。在用於開放式時間檢索的 VUE-TR-V2基準上,其總體 IoU 達到 48.75,尤其在**超長視頻(超過1小時)**上的表現比商業模型領先 17.5個百分點。在定位任務(VUE-STG)上,模型也取得了vIoU32.57和tIoU53.19的最佳性能。

從模型到產品:TikTok的“智能剪輯師”

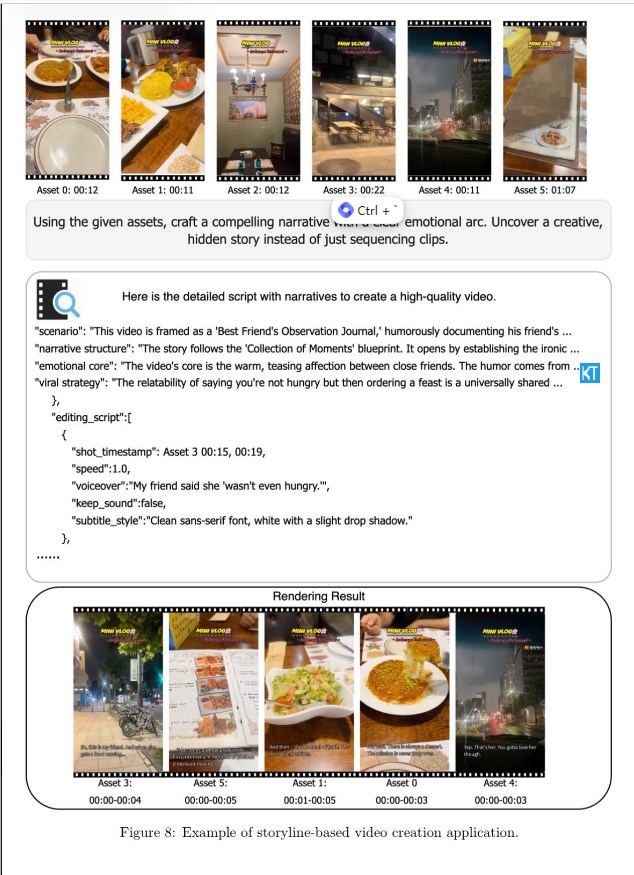

基於 Vidi2的強大能力,字節跳動已開發出多個實用的自動化編輯工具,包括:高光提取、故事感知剪切、內容感知重構圖和多視角切換,且這些功能都可以在消費級硬件上運行。

TikTok應用:相關技術已應用於 TikTok的Smart Split 功能,能夠自動剪輯、重構圖、添加字幕,並將長視頻轉錄成適合TikTok的短片段。

AI Outline:該工具能將簡單提示或熱門話題轉化爲結構化的視頻標題、開頭和大綱。

AIbase 評論指出,Vidi2的發佈和字節跳動巨大的 **TikTok(10億日活用戶)**數據平臺優勢,使其獲得了海量視頻數據進行訓練和實時反饋優化,爲原生的AI公司帶來了巨大挑戰。隨着大平臺公司的技術飛輪轉動起來,傳統AI公司可能面臨更大的競爭壓力。

目前 Vidi2仍處於研究階段,官方表示 Demo 即將發佈。

地址:https://www.alphaxiv.org/abs/2511.19529