バイトダンスは最新のマルチモーダル大規模言語モデル Vidi2を発表しました。このAIモデルは120億パラメータを持ち、動画理解に特化しています。数時間にわたる原始的な素材を処理し、そのストーリーの流れを理解し、簡単なヒントに基づいて完全なTikTok動画や映画のシーンを生成することができ、既存の動画編集業界にとって大きな変革と見なされています。

突破: 精細な時空間定位(STG)

Vidi2の鍵となるのはその動画理解能力です。新モデルには精細な時空間定位(STG)機能が追加され、動画中のタイムスタンプと対象オブジェクトの境界ボックスを同時に認識できます。テキストクエリが与えられると、Vidi2は対応する期間だけでなく、これらの期間内で具体的な物体の位置を正確にマークします。

技術的な詳細:

時空間定位: モデルは「パイプライン」(時間インデックスの境界ボックス)を返し、1秒単位で指定されたオブジェクトや人物をトラッキングし、例えば群衆の中で特定の人物を追跡するなど、直接編集をサポートします。

技術アーキテクチャ: Vidi2はGemma-3をメインネットワークとして使用し、再設計された適応的マーカー圧縮技術を補助として採用することで、長時間の動画処理において効率を保ちながら重要な詳細を失わないようにしています。

性能優位: 超長動画理解の利点

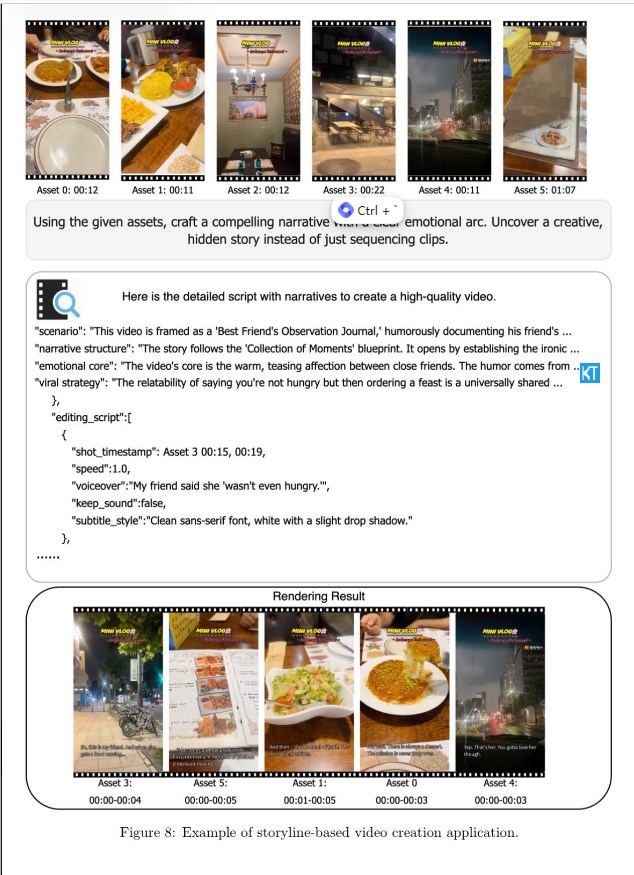

Vidi2は業界の基準テストで優れた結果を示しています。オープンな時間検索用のVUE-TR-V2ベンチマークでは、全体のIoUが48.75に達し、特に**超長動画(1時間以上)**では商業モデルよりも17.5ポイント Vidi2の強力な能力を基に、バイトダンスは複数の実用的な自動編集ツールを開発しており、ハイライト抽出、ストーリー感知カット、コンテンツ感知構成図、多視点切り替えなどの機能があります。これらの機能は、消費者向けハードウェアでも動作可能です。 TikTokアプリ: 関連技術はTikTokのSmart Split機能に応用されており、長時間の動画を自動的にカットし、構成図を作成し、字幕を追加し、長時間の動画をTikTokに適した短いセグメントに変換することができます。 AI Outline: このツールは、簡単なヒントやトレンド話題を構造化された動画タイトル、オープニング、およびアウトラインに変換します。 AIbaseのコメントによると、Vidi2のリリースとバイトダンスが持つ膨大なTikTok(10億人のアクティブユーザー)データプラットフォームの優位性により、大量の動画データを訓練とリアルタイムフィードバック最適化に使用できるため、ネイティブAI企業にとって大きな課題となっています。大手プラットフォーム企業の技術飛輪が回り始めると、従来のAI企業はより大きな競争圧力を受けることになります。 現在、Vidi2は研究段階にあり、公式にはデモが近日中に公開される予定です。 URL: https://www.alphaxiv.org/abs/2511.19529

モデルから製品へ:TikTokの「スマートカット担当者」

業界への影響: バイトダンスのAI飛輪が始動