最近,中國研究人員推出了一款名爲 DeepEyesV2的多模態人工智能模型,它可以分析圖像、執行代碼並進行網絡搜索。與依賴訓練期間獲得的知識的傳統模型不同,DeepEyesV2通過智能利用外部工具,表現出色,許多情況下超越了更大型的模型。

在早期實驗中,研究團隊發現僅依靠強化學習不足以穩定地使用工具進行多模態任務。最初,模型嘗試爲圖像分析編寫 Python 代碼,但經常生成錯誤的代碼片段。隨着訓練的深入,模型甚至開始完全跳過工具的使用。

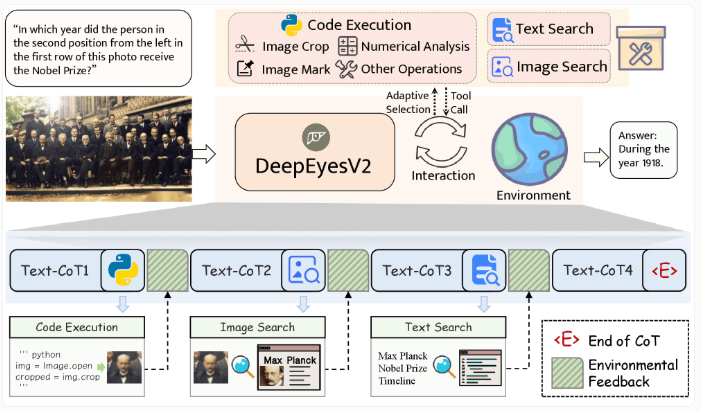

爲了解決這個問題,研究團隊開發了一種兩階段的訓練流程。第一階段,模型學習將圖像理解與工具使用相結合;第二階段,利用強化學習來優化這些行爲。通過使用領先的模型生成高質量示例,研究人員確保了工具使用路徑的準確性和清晰度。

DeepEyesV2使用三種工具類別來處理多模態任務:代碼執行用於圖像處理和數值分析,圖像搜索用於檢索相似內容,而文本搜索則提供圖像中不可見的上下文信息。模型通過整合圖像操作、Python 執行和圖像 / 文本搜索,適應不同的查詢。

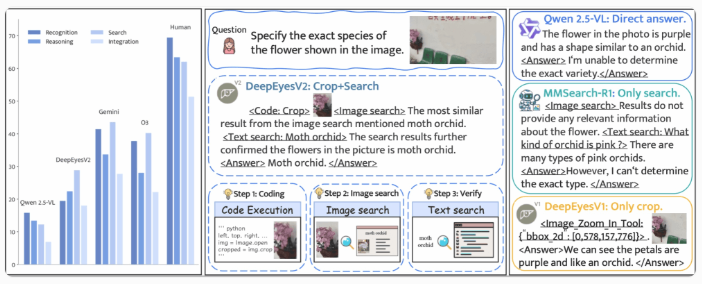

爲了評估這種方法,研究團隊創建了 RealX-Bench 基準測試,以檢驗模型在視覺理解、網絡搜索和推理方面的協調能力。研究表明,即便是表現最強的專有模型,準確率也僅達到46%,而人類則達到了70% 的準確率。在需要同時運用三種技能的任務中,當前模型的表現更是不盡如人意。

DeepEyesV2在多個基準測試中表現出色,在數學推理任務中,準確率達到了52.7%,在搜索驅動任務中,則達到了63.7%。這顯示出通過精心設計的工具使用,可以彌補較小模型的侷限性。

DeepEyesV2現已在 Hugging Face 和 GitHub 上發佈,使用 Apache License2.0可供商業使用,繼續推動多模態 AI 的發展。

論文:https://arxiv.org/abs/2511.05271

劃重點:

🌟 DeepEyesV2利用智能工具提升多模態任務的表現,超越大型模型。

🔧 採用兩階段訓練流程,結合圖像理解與工具使用。

📈 在多個基準測試中表現優秀,展現出較小模型的潛力。