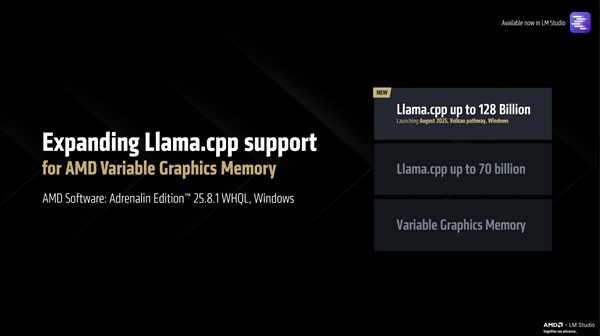

在科技飛速發展的今天,AMD 再一次引領潮流,推出了基於 Zen5架構的銳龍 AI Max+395。這款處理器不僅是行業的佼佼者,更是首個能夠在本地運行700億參數 AI 大模型的平臺。而現在,AMD 宣佈重磅升級,銳龍 AI Max+395可以支持本地運行高達1280億參數的大模型,進一步拓展了其在 AI 領域的應用潛力。

爲了實現這樣的性能,銳龍 AI Max+395依舊需要搭配128GB 的統一內存,其中96GB 必須被分配作爲顯存。此外,該處理器還要求在 Vulkan llama.cpp 環境下運行,這爲開發者提供了更大的靈活性。新的升級使得銳龍 AI Max+395成爲第一個能夠運行1090億參數的 Meta Llama4Sout 大模型的平臺,該模型體積達66GB,支持多種高級功能如 Vision 和 MCP。

這次升級的核心在於混合專家(MoE)模式,這種模式每次僅激活模型的一部分,從而在保持性能的同時大幅降低資源消耗。銳龍 AI Max+395在實際測試中可以實現每秒15Tokens 的處理速度,表現相當出色。同時,它還支持68GB 體積、1230億參數的 Mistral Large 模型,以及其他多個小型模型,如18GB、300億參數的 Qwen3A3B 和17GB、270億參數的 Google Gemma。

更爲驚人的是,銳龍 AI Max+395在上下文處理上也有了質的飛躍,最大支持256000Tokens 的上下文長度,讓其能夠處理和分析更爲複雜的數據資料。雖然一般的非大規模模型在32000Tokens 的上下文下已足夠,但此次升級後的處理器帶來了更多可能性,往日需要高端設備才能實現的超大規模上下文,如今也能在 AMD 的產品中輕鬆實現。

價格方面,搭載銳龍 AI Max+395及128GB 內存的迷你 AI 工作站,現已降至1.3萬元左右,性價比顯著提升,極大地降低了高端 AI 應用的門檻。