Liquid AI 宣佈正式開源其下一代 Liquid Foundation Models(LFM2),這一突破性舉措在人工智能領域掀起熱議。作爲專爲邊緣設備優化的高效混合模型,LFM2在速度、能效和性能上樹立了新的行業標準。AIbase 整理了近期網絡信息,深入剖析 LFM2的技術亮點及其對 AI 生態的深遠影響。

LFM2:重新定義邊緣AI的性能邊界

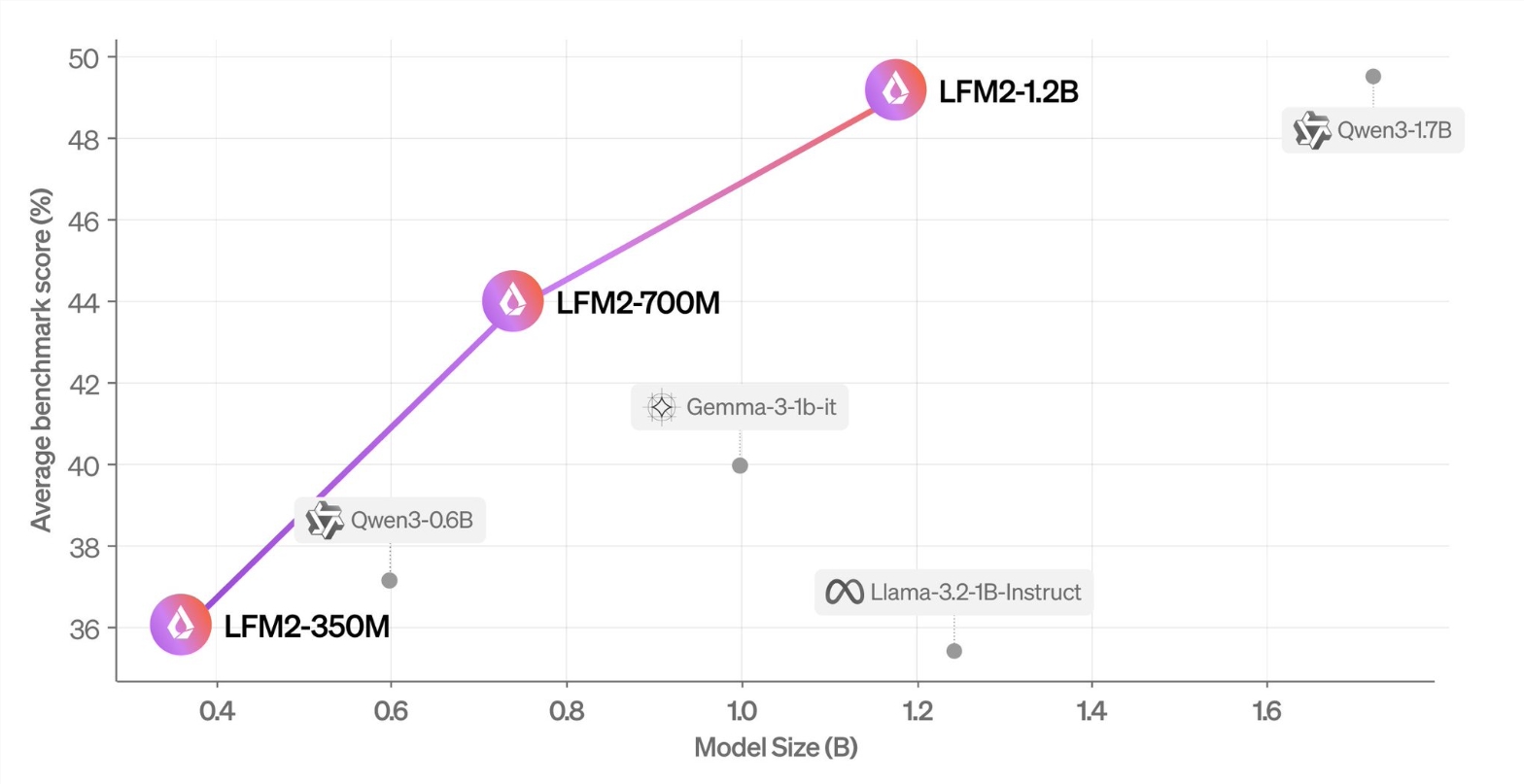

LFM2系列包括350M、700M 和1.2B 三個參數規模的模型,專爲智能手機、筆記本電腦、汽車及嵌入式系統等邊緣設備設計。與傳統基於 Transformer 的模型不同,LFM2採用了創新的結構化自適應算子架構。這種架構顯著提升了訓練效率和推理速度,尤其在長上下文和資源受限場景下表現出色。據報道,LFM2的推理速度比 Qwen3快2倍,訓練速度較 Liquid AI 之前的模型提升3倍,展現了其在邊緣計算領域的巨大潛力。

此外,LFM2在指令跟隨和函數調用等關鍵任務上表現優異,平均性能超越同等規模的模型,使其成爲本地化和邊緣 AI 應用的理想選擇。這種高效性不僅降低了部署成本,還爲隱私敏感場景提供了更安全的數據處理方案。

開源戰略:推動全球AI創新

通過開源 LFM2,Liquid AI 將模型權重完全公開,開發者可通過 Hugging Face 下載並在 Liquid Playground 進行測試。這一舉措不僅體現了 Liquid AI 對技術透明化的承諾,也爲全球開發者提供了探索新型 AI 架構的機會。LFM2的開源標誌着美國企業在高效小型語言模型領域首次公開超越中國領先的開源模型,如阿里巴巴和字節跳動開發的模型,展現了其在全球 AI 競賽中的技術自信。

值得一提的是,Liquid AI 計劃將 LFM2集成到其邊緣 AI 平臺及即將推出的 iOS 原生應用中,進一步擴展其在消費級市場的應用場景。這一戰略佈局表明,Liquid AI 不僅關注技術創新,還致力於通過開源和生態建設推動 AI 的普及化。

技術亮點:高效、隱私、長上下文

LFM2的核心優勢在於其獨特的技術設計。模型支持32K 上下文長度、bfloat16精度和65K 詞彙表,採用 ChatML 風格優化交互體驗。這些特性使其在處理複雜任務時兼顧高效與精準。此外,LFM2的低延遲和高能效設計使其特別適合資源受限的邊緣設備,爲隱私敏感的本地化 AI 應用提供了可靠支持。

與此同時,LFM2的開源爲開發者提供了深入研究新型 AI 架構的機會。相比傳統的 Transformer 模型,LFM2的混合架構在性能和效率之間取得了巧妙平衡,預示着邊緣 AI 技術的新方向。

行業影響:邊緣AI的未來風向標

LFM2的發佈不僅是 Liquid AI 的技術里程碑,也爲邊緣 AI 領域樹立了新標杆。在全球 AI 競爭日益激烈的背景下,LFM2的高效性和開源策略爲中小型企業和獨立開發者提供了低成本、高性能的 AI 解決方案。同時,其對隱私和本地化計算的重視順應了數據主權和隱私保護的全球趨勢。

AIbase 認爲,LFM2的開源不僅推動了技術民主化,還可能激發更多創新應用,從智能家居到自動駕駛,再到醫療設備,LFM2的潛力正在被逐步挖掘。未來,隨着更多開發者參與到 LFM2的生態建設中,邊緣 AI 的發展將迎來新的加速期。

huggingface:https://huggingface.co/collections/LiquidAI/lfm2-686d721927015b2ad73eaa38