2025年7月,阿里巴巴通義實驗室正式開源其首款音頻生成模型ThinkSound,爲視頻內容創作帶來革命性突破。這款多模態AI模型能夠基於視頻、文本或音頻輸入,生成高保真的音效與音景,完美適配畫面內容,爲影視製作、遊戲開發及多媒體創作注入全新活力。AIbase結合最新信息,深入剖析ThinkSound的獨特優勢與行業影響,帶您一探AI音效生成的新前沿。

ThinkSound:AI“音效師”驚豔亮相

ThinkSound是阿里巴巴通義實驗室推出的一款創新性音頻生成模型,採用先進的鏈式推理(Chain-of-Thought, CoT)技術,能夠深入分析視頻畫面的場景、動作與情感,生成與之高度匹配的音效。無論是自然風聲、城市喧囂,還是角色對話與物體碰撞音,ThinkSound都能實現音畫高保真同步,生成效果逼真自然。官方展示的案例顯示,其生成的音效在真實感與場景適配度上表現優異,堪稱“專業AI音效師”。

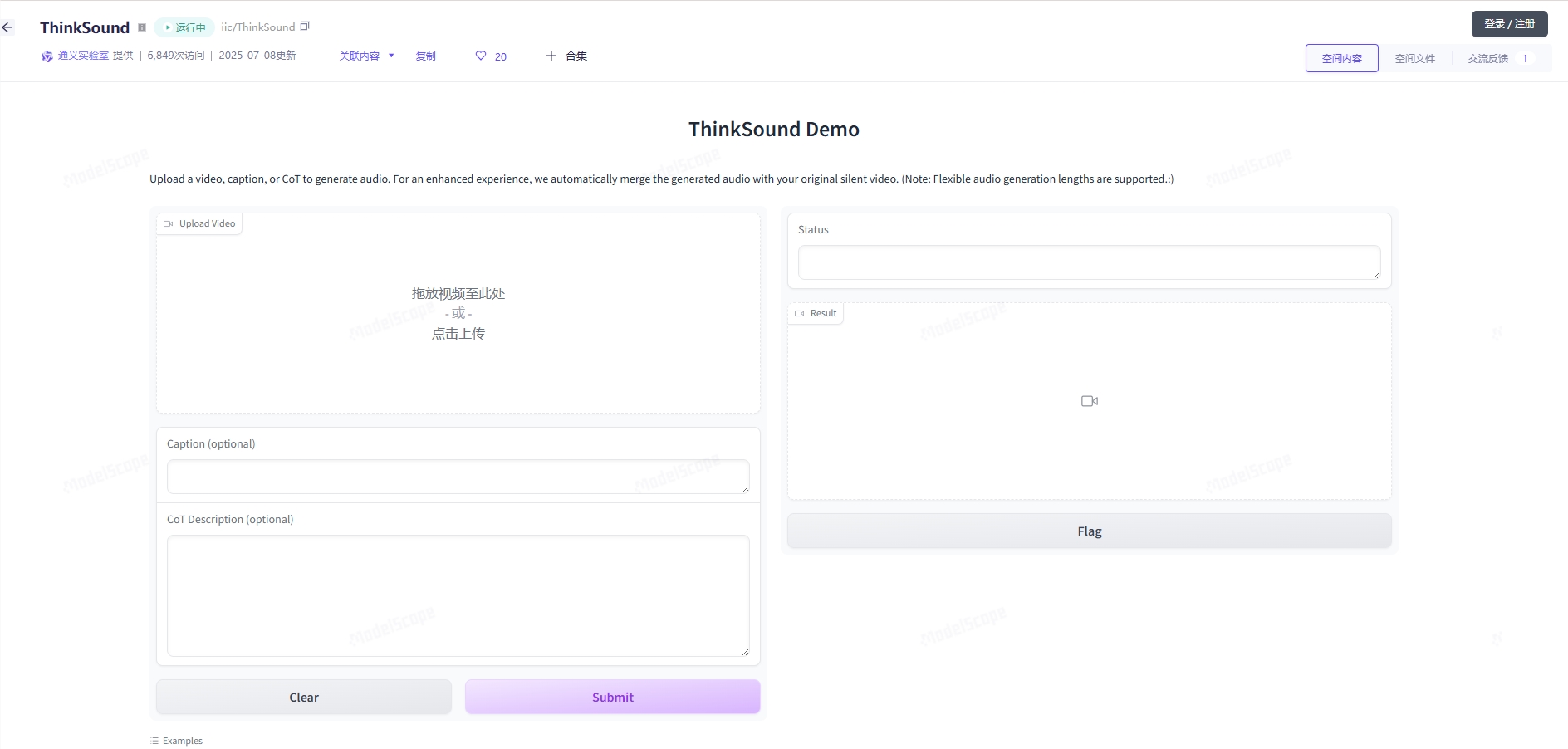

體驗地址:https://www.modelscope.cn/studios/iic/ThinkSound

該模型支持多種輸入模態,包括視頻、文本、音頻或其組合,極大地拓寬了應用場景。用戶可以通過簡單的文字描述或視頻片段,快速生成符合特定場景的音效,甚至支持通過語言指令進行精準的音效編輯與優化。

技術亮點:多模態融合與高精度同步

ThinkSound的核心優勢在於其多模態AI架構,融合了計算機視覺、自然語言處理與音頻生成技術。其先進的計算機視覺算法能夠逐幀分析視頻內容,理解物體交互、環境背景及人物行爲,從而生成高度契合的音效與音景。例如,在自然場景中,ThinkSound可生成潺潺流水或鳥鳴聲;在都市場景中,則能精確還原車輛鳴笛與人羣喧鬧。

此外,ThinkSound在音畫同步方面表現尤爲出色。其算法確保音頻與視頻幀的精準對齊,支持包括MP4、MOV、AVI和MKV在內的多種視頻格式,兼容從標清到4K分辨率,滿足不同創作需求。官方數據顯示,ThinkSound在視頻-音頻生成基準測試中位居行業前列,展現了其強大的技術實力。

開源賦能:降低創作門檻,助力全球開發者

作爲阿里巴巴開源戰略的重要一環,ThinkSound的模型權重與推理腳本已全面開放,開發者可通過Hugging Face、ModelScope及GitHub免費獲取。這一舉措大幅降低了AI音效生成的技術門檻,使中小型創作者、獨立開發者及學術研究人員能夠輕鬆接入專業級音效生成工具。ThinkSound還提供交互式編輯功能,支持通過點擊或語言指令對特定音效進行精細調整,極大地提升了創作靈活性。

阿里巴巴此前已在AI領域多次開源,包括Qwen語言模型與Wan2.1視頻生成模型,累計下載量超330萬次,展現了其對全球AI生態的深遠貢獻。此次ThinkSound的開源,進一步鞏固了阿里巴巴在多模態AI領域的領先地位

應用場景:從影視到遊戲,開啓音效新革命

ThinkSound的應用潛力廣泛,覆蓋影視後期製作、遊戲音效設計、互動媒體及教育內容創作等多個領域。對於影視創作者,ThinkSound能夠快速爲無聲視頻生成環境音效、角色對話或背景音樂,顯著提升後期製作效率。遊戲開發者則可利用其生成動態音效,爲虛擬場景增添沉浸感。此外,ThinkSound的語音合成技術支持多語言對話生成,結合精準的脣部同步與情感表達,爲虛擬角色賦予更真實的生命力。

用戶反饋顯示,ThinkSound已受到衆多內容創作者與音效專業人士的青睞,其在簡化工作流程、提升創作質量方面的表現尤爲突出。未來,隨着更多開發者基於ThinkSound進行二次開發,預計將催生更多創新應用場景。

未來展望:多模態AI的下一站

ThinkSound的發佈標誌着AI音效生成技術邁入新階段,其多模態融合與鏈式推理技術的應用,爲行業樹立了新標杆。相較於傳統的音效生成工具,ThinkSound不僅提升了生成效率,還在音畫同步與情感表達上實現了質的突破。結合阿里巴巴在視頻生成(Wan2.1系列)與語音生成(Qwen-TTS、FunAudioLLM)領域的持續創新,多模態AI的未來發展潛力無限。

AIbase觀點:ThinkSound的開源不僅爲內容創作者提供了高效工具,也爲AI音效生成領域注入了新的活力。未來,隨着多模態AI技術的進一步成熟,音效生成將在真實感、個性化與交互性上實現更大突破。阿里巴巴的開源戰略無疑將加速這一進程,爲全球AI生態帶來更多可能性。