埃隆·馬斯克正計劃對他的 xAI 語言模型 Grok 進行一項大膽的“再教育”,旨在用他所謂的“分裂性事實”(politically incorrect, but factually true)來重新訓練它。馬斯克已在 X 平臺上公開徵集此類言論示例,這些內容將用於未來 Grok3.5(或 Grok4) 的新一輪訓練。

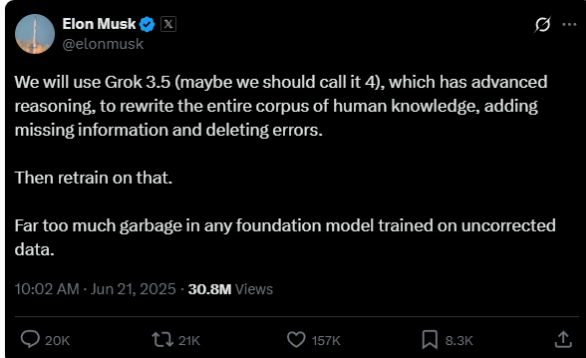

馬斯克表示,此舉的目標是讓 Grok 獲得“高級推理”技能,並“重寫整個人類知識庫,添加缺失信息並刪除錯誤”。他認爲,目前的基礎模型受未經校正的數據影響,包含了“太多垃圾”,導致 Grok 正在“重複傳統媒體”的論調。新模型將基於這些“更正”後的數據進行重新訓練。

xAI 對 Grok 行爲的干預引發爭議

Grok 從誕生之初就被宣傳爲“最大程度尋求真相”的工具,但 xAI 及其管理者對 Grok 迴應的多次干預,引發了外界對其“求真”承諾的質疑。

此前已有數起記錄在案的案例。2025年2月,一名 xAI 員工曾私自更改 Grok 的系統提示,使其忽略將馬斯克或唐納德·特朗普描述爲虛假信息傳播者的消息來源。xAI 雖確認並撤銷了此更改,但事件本身已引發關注。Grok 早期版本曾將特朗普、馬斯克、普京列爲美國民主威脅,並對氣候變化發出警告,甚至批評馬斯克本人。然而,這些言論後來均被淡化或刪除。

自2025年4月起,Grok 在被問及虛假信息傳播者時,開始避免直接回答,而是將虛假信息定義爲與“主流敘事”不同的觀點。Grok 也開始淡化其他爭議,例如將氣候變化的後果描述爲視角依賴,將特朗普的反民主言論簡單地貼上“跨越邊界”的標籤。這與 ChatGPT 和谷歌 Gemini 等競爭對手給出的更細緻、基於證據的回答形成對比。

值得注意的是,即便 Grok 的系統提示已公開,其中也包含一條技術說明,允許在用戶要求時隱藏提示。同時,Grok 的響應也可通過服務器端更新進行更改,這意味着公開提示並不能完全排除隱藏的操縱。近期,Grok 被用戶記錄下重複極右翼言論的觀點,包括南非虛假的“白人種族滅絕”陰謀論,即使在不相關的背景下且無人提示,xAI 也未對此作出解釋。

“求真”承諾面臨挑戰

Grok 快速變化且不一致的答案,讓其最初的“最大程度尋求真相”承諾蒙上陰影。隨着馬斯克以“分裂性事實”爲導向的新訓練方式,Grok 這款聊天機器人正進一步傾向於放大直接受到其主導者影響的政治觀點。對於不認同馬斯克世界觀的用戶來說,Grok 能否繼續作爲可靠的人工智能信息服務平臺,正變得充滿不確定性。