6月17日,上海的 AI 獨角獸公司 MiniMax 發佈了其全新研發的 MiniMax-M1系列模型,號稱是全球首個開源的大規模混合架構推理模型。這個創新的模型在上下文處理能力和成本控制方面都取得了顯著的突破。

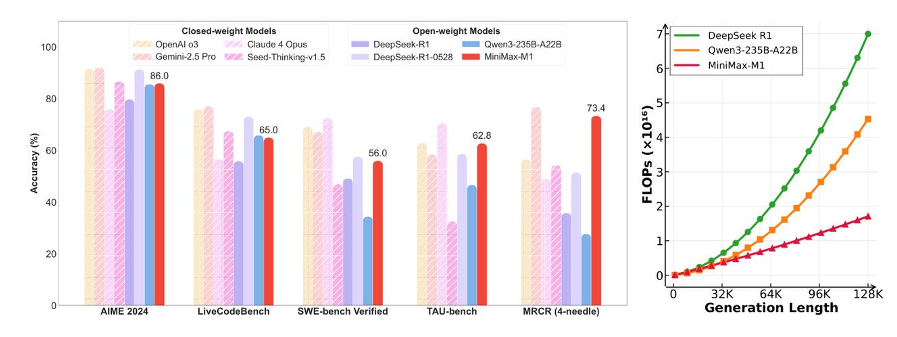

MiniMax-M1模型的最大亮點在於其原生支持高達100萬 Token 的上下文窗口,甚至在推理輸出上支持業內最長的8萬 Token。這一技術進步與谷歌的 Gemini2.5Pro 相當,同時在工具使用場景(TAU-bench)中,MiniMax-M1-40k 的表現超過了 Gemini-2.5Pro,展現了其強大的實力。此外,MiniMax 還表示,M1模型的強化訓練成本僅爲53.5萬美元,相比以往減少了一個數量級。

在定價策略上,MiniMax 採用了階梯式定價,隨着輸入文本長度的增加,費用也會相應提高。具體來說,0-32k Token 的輸入費用爲每百萬 Token0.8元,而輸出則爲每百萬 Token8元;32k-128k Token 則爲1.2元和16元;128k-1M Token 的輸入和輸出費用分別爲2.4元和24元。這一價格設置使得 MiniMax-M1在市場上更具競爭力,尤其是在前兩個檔位的定價上,均低於同類產品 DeepSeek-R1。

值得一提的是,MiniMax 此次還推出了 CISPO 算法,其收斂速度比字節跳動最近推出的 DAPO 算法快了一倍,強化學習階段的算力需求僅爲 DeepSeek R1的30%。這使得 MiniMax-M1模型的訓練更加高效,使用的算力資源顯著減少,進一步降低了運營成本。

在 AI 行業的 “六小虎” 競爭者面前,MiniMax 的這一發布標誌着其希望在大模型的競爭中繼續前行。隨着 DeepSeek R2的即將推出,未來的市場局勢將更加複雜。MiniMax 也在持續進行開源技術的更新,預計在接下來的日子裏會有更多的技術和產品亮相。