Meta 的 FAIR 團隊最近推出了一款名爲 Dualformer 的全新 Transformer 模型,該模型模仿人類的雙重認知系統,能夠無縫整合快速和慢速推理模式,在推理能力和計算效率上取得了顯著突破。

人類的思維過程通常被認爲是由兩種系統控制的:系統1快速直觀,系統2則更慢但更具邏輯性。

傳統的 Transformer 模型通常只模擬了系統1或系統2中的一種,導致模型要麼速度快但推理能力差,要麼推理能力強但速度慢且計算成本高。

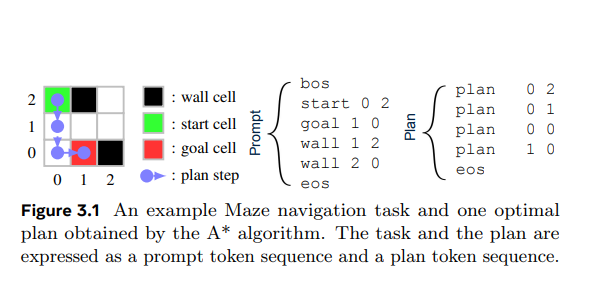

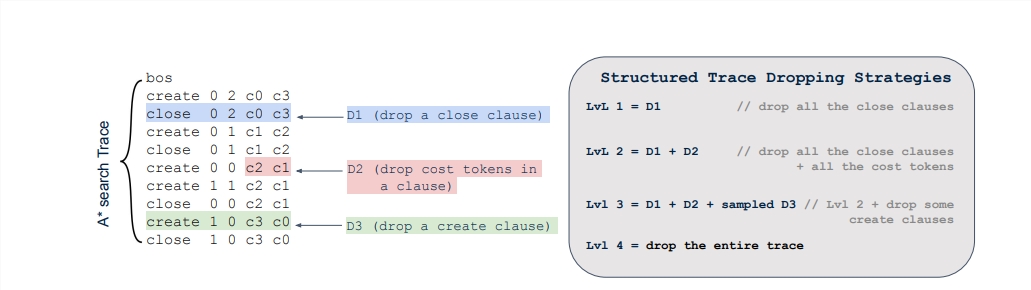

Dualformer 的創新之處在於其訓練方式。研究人員利用隨機推理軌跡對模型進行訓練,在訓練過程中隨機丟棄軌跡的不同部分,類似於分析人類思維過程並創建捷徑。這種訓練策略使 Dualformer 能夠在推理時靈活切換不同的模式:

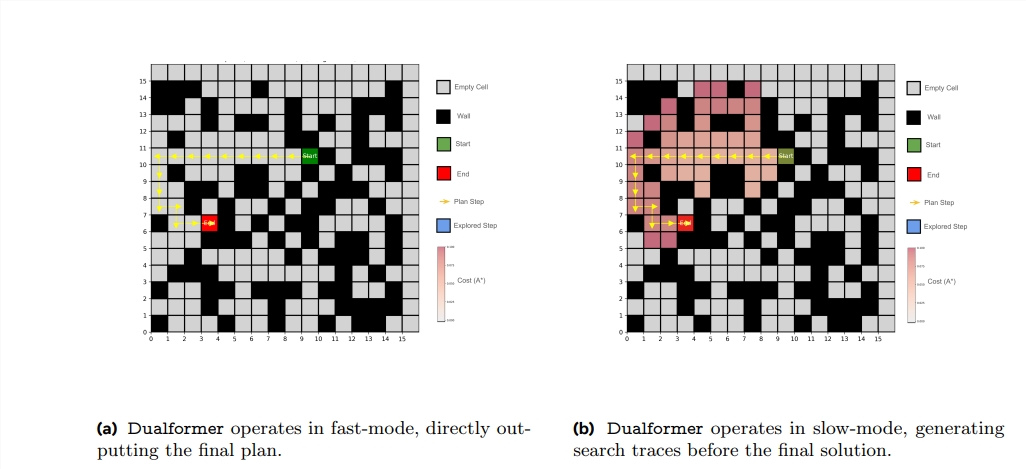

快速模式: Dualformer 只輸出最終解決方案,速度極快。

慢速模式: Dualformer 會輸出完整的推理鏈和最終解決方案,推理能力更強。

自動模式: Dualformer 可以根據任務的複雜程度自動選擇合適的模式。

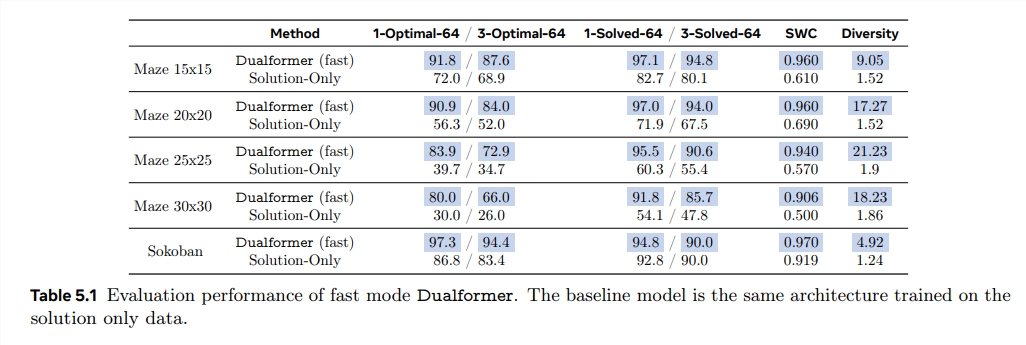

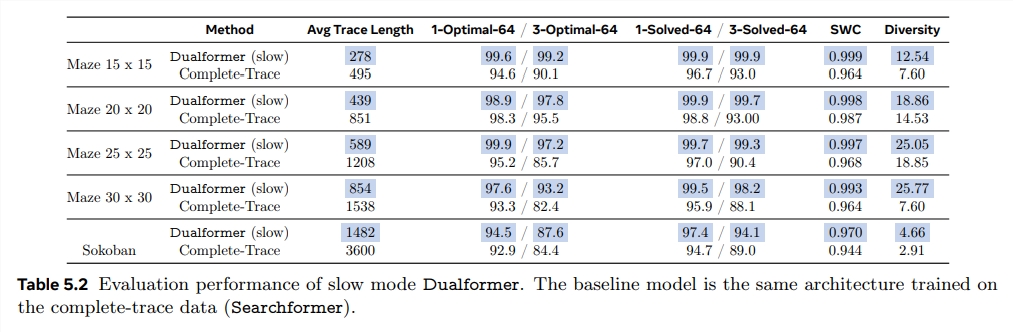

實驗結果表明,Dualformer 在迷宮導航和數學問題求解等任務上表現出色。在慢速模式下,Dualformer 能夠以97.6% 的成功率解決30x30的迷宮導航任務,超越了只使用完整推理軌跡訓練的 Searchformer 模型,同時推理步驟減少了45.5%。

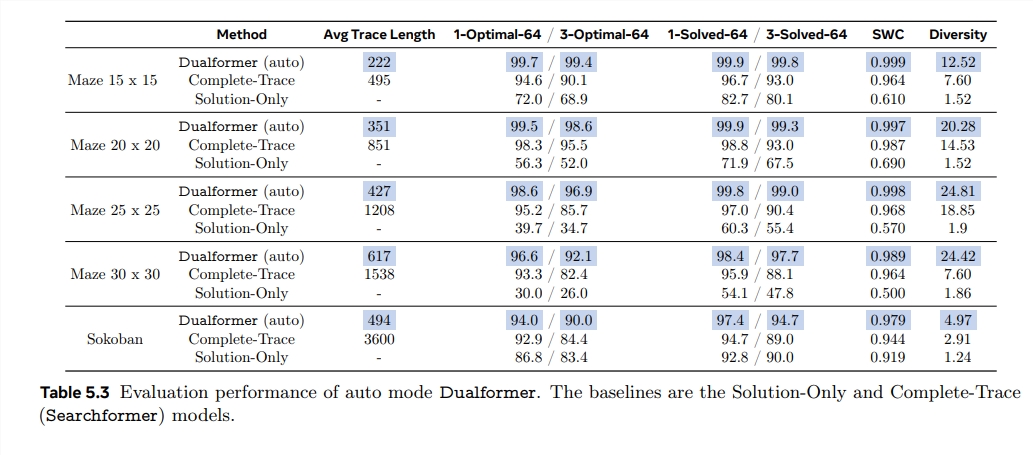

在快速模式下,Dualformer 的成功率也高達80%,遠高於只使用最終解決方案訓練的 Solution-Only 模型。在自動模式下,Dualformer 則能夠在保持高成功率的同時,顯著減少推理步驟。

Dualformer 的成功表明,將人類認知理論應用於人工智能模型設計能夠有效提升模型的性能。這種融合快慢思維的模式爲構建更強大、更高效的 AI 系統提供了新的思路。

論文地址:https://arxiv.org/pdf/2410.09918