微軟宣佈發佈三款全新的 Phi-3.5模型,進一步鞏固了其在多語言和多模態人工智能發展的領先地位。這三款新模型分別是:Phi-3.5-mini-instruct、-3.5-MoE-instruct 以及 Phi-3.5-vision-instruct,各自針對不同的應用場景。

Phi-3.5Mini Instruct 模型是一個輕量級的 AI 模型,參數數量爲3.8億,非常適合計算能力有限的環境。它支持128k 的上下文長度,專門優化了指令執行能力,適合代碼生成、數學問題求解和邏輯推理等任務。儘管體積不大,這款模型在多語言和多輪對話任務中表現出了令人矚目的競爭力,超越了同類的其他模型。

入口:https://huggingface.co/microsoft/Phi-3.5-mini-instruct

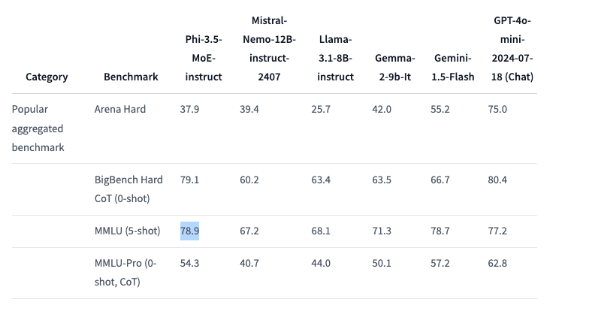

Phi-3.5MoE 模型,這是一款 “專家混合” 模型,結合了多種不同類型的模型,每個都專注於特定任務。它擁有419億的參數,支持128k 的上下文長度,可以在多種推理任務中展現強大的性能。這款模型在代碼、數學和多語言理解方面的表現都非常出色,甚至在一些基準測試中超過了更大型的模型,比如在 MMLU(大規模多任務語言理解)上超越了 OpenAI 的 GPT-4o mini。

入口:https://huggingface.co/microsoft/Phi-3.5-MoE-instruct

Phi-3.5Vision Instruct 模型是一款先進的多模態 AI 模型,集成了文本和圖像處理能力,適合圖像理解、光學字符識別、圖表和表格分析以及視頻總結等任務。這款模型同樣支持128k 的上下文長度,能夠處理複雜的多幀視覺任務。

入口:https://huggingface.co/microsoft/Phi-3.5-vision-instruct

爲了訓練這三款模型,微軟進行了大規模的數據處理。Mini Instruct 模型使用了3.4萬億個標記,在512個 H100-80G GPU 上訓練了10天;Vision Instruct 模型則用了5000億個標記,經過6天的訓練;而 MoE 模型則是在23天內使用了4.9萬億個標記進行訓練。

值得一提的是,這三款 Phi-3.5模型均採用 MIT 開源許可證發佈,開發者可以自由使用、修改和分發這些軟件。這不僅體現了微軟對開源社區的支持,也讓更多的開發者能夠在自己的應用中集成尖端的 AI 能力。

劃重點:

🌟 微軟推出三款新 AI 模型,分別針對輕量級推理、混合專家和多模態任務。

📊 Phi-3.5MoE 在基準測試中超越 GPT-4o mini,表現出色。

📜 三款模型均採用 MIT 開源許可證,開發者可自由使用和修改。