OpenAI は最近、AI セキュリティ分野での応用を専門とする2種類の新しいオープンウェイトモデル「gpt-oss-safeguard-120b」と「gpt-oss-safeguard-20b」を発表しました。これらのモデルは以前にリリースされた「gpt-oss」シリーズをもとに最適化されており、Apache2.0ライセンスに従い、誰でも自由に使用・変更・デプロイすることが可能です。

新モデルの大きな特徴の一つは、開発者がカスタムセキュリティポリシーに基づいて推論分類を行うことができる点です。これは従来の「一括処理」型のセキュリティシステムを打破しています。開発者は推論時に自身のセキュリティポリシーと検査対象のコンテンツを入力し、モデルはそれらのポリシーに基づいて分類を行い、それに基づいた推論理由を提供します。セキュリティポリシーは柔軟に調整可能で、モデルの性能向上に役立ちます。これにより、gpt-oss-safeguardモデルはユーザーのメッセージ、チャットの返信、あるいは完全な会話の分類に対応でき、さまざまなニーズに合わせることができます。

OpenAIは、この新モデルがいくつかの特定の状況に特に適していると指摘しています。例えば、潜在的な危険が現れたり進化したりする際には、セキュリティポリシーが迅速に調整される必要がある場合があります。また、高度に細分化された分野では、従来の小規模な分類器が効果的に機能できない場合もあります。さらに、開発者が大量の高品質なサンプルを持たない場合、高性能な分類器を訓練するのは困難です。また、分類結果の質や説明性を処理速度よりも優先したいシナリオにおいても、これらの新モデルは理想的な選択肢となります。

しかし、gpt-oss-safeguardにはいくつかの制限もあります。OpenAIによると、大量のラベル付きサンプルがあり、従来の分類器をトレーニングできるプラットフォームでは、複雑または高リスクのシナリオにおいて、後者のほうが依然としてより優れた性能を発揮し、カスタマイズされたモデルの方が正確度が高い可能性があります。また、この新モデルは処理速度とリソース消費量が大きいため、大規模なリアルタイムコンテンツスクリーニングには向いていません。

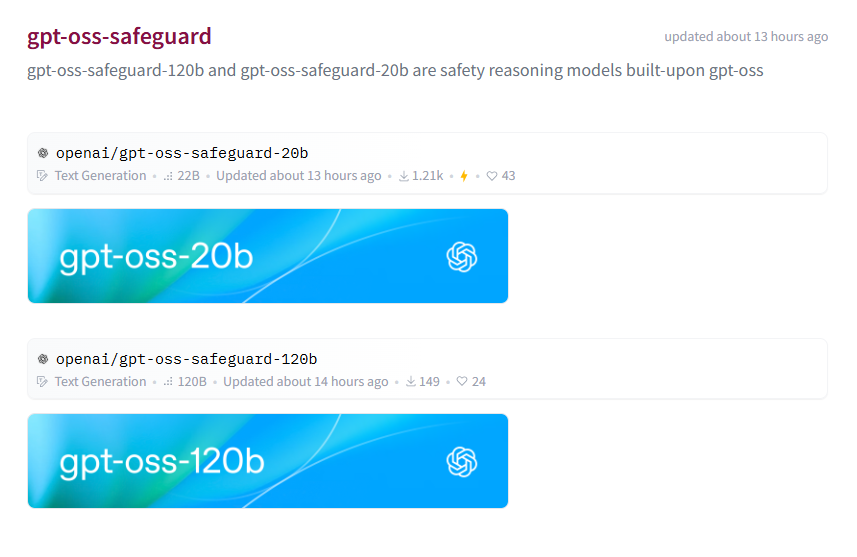

現在、gpt-oss-safeguard-120bとgpt-oss-safeguard-20bはHugging Faceプラットフォームで無料でダウンロード可能であり、多くの開発者にとって探索と応用が容易です。

https://huggingface.co/collections/openai/gpt-oss-safeguard

ポイント:

🛡️ OpenAI は「gpt-oss-safeguard-120b」と「gpt-oss-safeguard-20b」という2つの新しいセキュリティモデルをリリースし、セキュリティポリシーを柔軟にカスタマイズできます。

⚙️ 新モデルは、入力されたセキュリティポリシーに基づいてユーザーのメッセージや会話を分類し、推論の理由を提示できます。

📊 一方で、一部のシナリオでは従来の分類器がより効果的であり、新モデルはリソースを多く消費します。