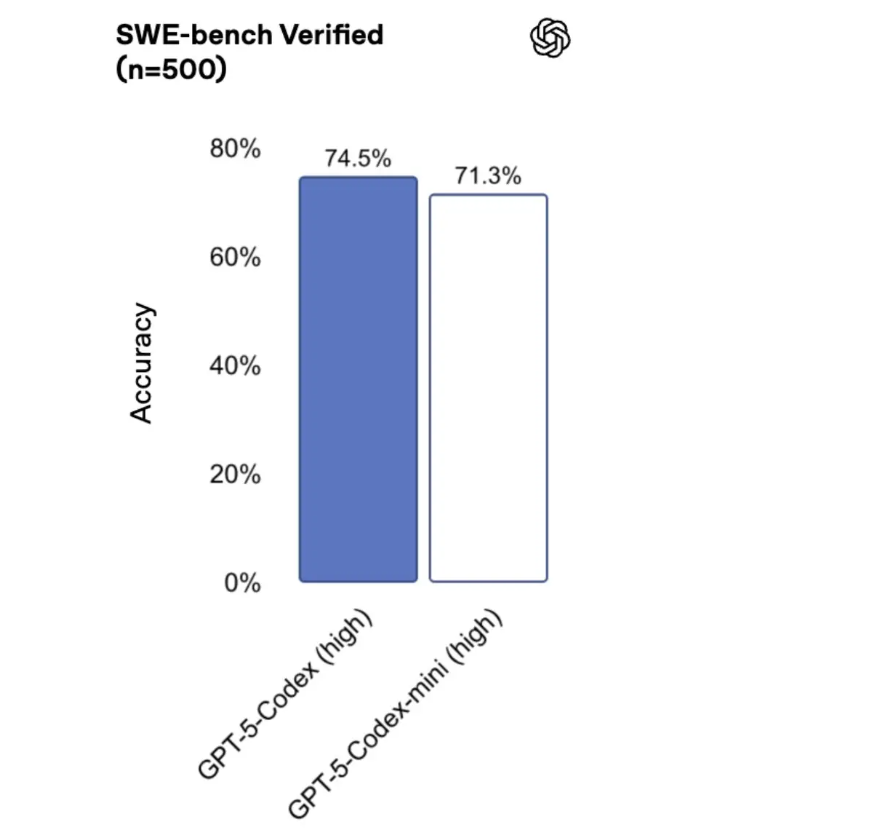

近日,OpenAI 宣佈正式上線了一款全新的輕量級模型 ——GPT-5Codex Mini。該模型專注於提供更高效且成本更低的代碼生成能力,旨在爲開發者提供更靈活的選擇。與此同時,OpenAI 還擴大了 Codex 的使用額度,允許用戶在現有的訂閱計劃和積分體系下獲取更多的調用量。

在服務層級的調整方面,OpenAI 也帶來了顯著的變化。針對 ChatGPT Plus、Business 和 Edu 用戶,速率限制提升了約50%,這意味着用戶在處理請求時將體驗到更流暢的服務。而對於 ChatGPT Pro 和 Enterprise 用戶,他們將享有優先處理的待遇,進一步縮短響應時間,確保關鍵時刻不掉鏈子。

OpenAI 還建議開發者在處理簡單的軟件工程任務或即將達到調用率限制時,選擇使用新發布的 GPT-5Codex Mini 模型。當用戶的調用量接近配額的90% 時,Codex 會智能推薦切換到這個新模型。GPT-5Codex Mini 現已支持命令行界面(CLI)和集成開發環境(IDE)的擴展,API 接口也將很快開放,便於更多開發者的使用。

在這次更新中,OpenAI 團隊對 Codex 的底層進行了優化,確保開發者在使用過程中的體驗更加一致。在此前的版本中,實際調用量可能受到流量負載和路由分配的影響而波動,而這次的優化措施有效解決了這一問題,讓用戶能夠在一天的工作中保持穩定的服務體驗。

OpenAI 的這一系列更新,無疑爲開發者提供了更多選擇和更高效的工作方式,進一步推動了 AI 在編程領域的應用。