7月29日,Qwen3-30B-A3B模型推出了新版本Qwen3-30B-A3B-Instruct-2507。這一新版本在多個關鍵領域實現了顯著提升,標誌着該模型在非思考模式(non-thinking mode)下僅激活3B參數,就能達到與Gemini2.5-Flash(non-thinking)、GPT-4o等頂尖閉源模型相媲美的性能。

新版本的Qwen3-30B-A3B-Instruct-2507在通用能力上取得了巨大進步,涵蓋了指令遵循、邏輯推理、文本理解、數學、科學、編程及工具使用等多個方面。這一改進不僅提升了模型的多功能性,還使其在處理複雜任務時表現得更加智能和高效。此外,該模型在多語言的長尾知識覆蓋方面也取得了顯著進步,能夠更好地理解和生成多種語言的文本,這對於全球化的應用場景來說是一個巨大的優勢。

在主觀和開放性任務中,新模型與用戶偏好的對齊更加緊密,能夠生成更高質量的文本,爲用戶提供更有幫助的回答。這一改進使得模型在與用戶的交互中更加自然和人性化,能夠更好地滿足用戶的需求。同時,長文本理解能力也得到了顯著提升,達到了256K,這進一步增強了模型的上下文理解能力,使其能夠處理更長的文本輸入,從而更好地理解和生成複雜的文本內容。

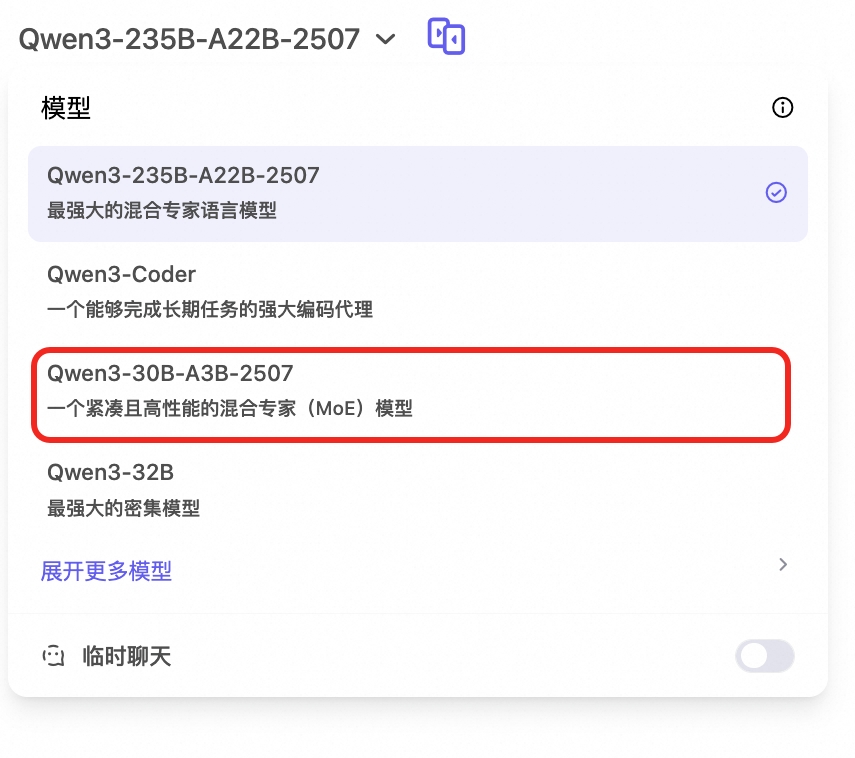

爲了方便開發者和研究人員使用和測試這一新模型,開發團隊已經在魔搭社區和HuggingFace等平臺開源了Qwen3-30B-A3B-Instruct-2507。此外,開發團隊還邀請用戶前往QwenChat(chat.qwen.ai)直接體驗這一新版本的強大功能。這一舉措不僅展示了開發團隊對模型性能的信心,也爲用戶提供了直接體驗和反饋的機會,有助於進一步優化和改進模型。