近日,阿里巴巴達摩院的研究團隊發佈了一項重要研究成果,名爲 “SHMT:自監督層次化妝轉移”,該論文已被國際頂級學術會議 NeurIPS2024接收。這項研究展示了一種新的化妝效果轉移技術,利用潛在擴散模型(Latent Diffusion Models)來實現化妝圖像的精準生成,爲化妝應用和圖像處理領域注入了新活力。

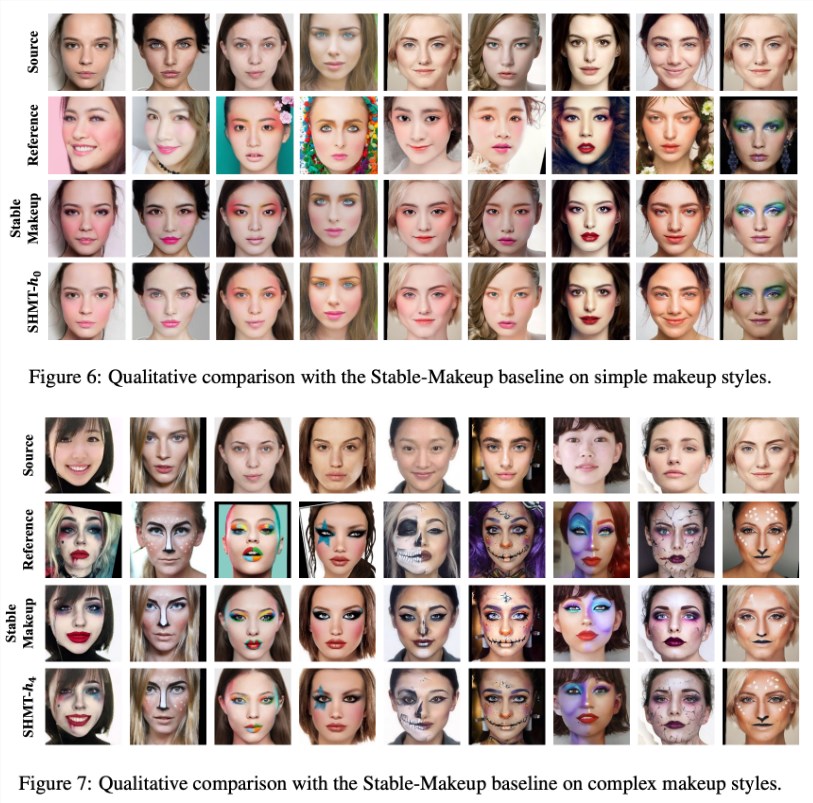

簡單的說,SHMT是一項妝容遷移技術,只要一個化妝的參考圖,和一張目標角色照片,就可以把妝容效果遷移到該目標臉上。

團隊在項目中採用了開源的方式,發佈了訓練代碼、測試代碼以及預訓練模型,使得研究人員能夠更方便地進行相關研究和開發。

在模型的搭建過程中,團隊推薦用戶創建一個名爲 “ldm” 的 conda 環境,並通過提供的環境文件快速完成設置。此外,研究中選用了 VQ-f4作爲預訓練的自編碼模型,用戶需將其下載並放入指定的檢查點文件夾,以便順利開始推理。

數據準備是 SHMT 模型成功運行的關鍵。研究團隊建議下載 “BeautyGAN” 提供的化妝遷移數據集,並將不同的化妝和非化妝圖像進行整合。同時,面部解析和3D 面部數據的準備也至關重要,相關工具和數據路徑在研究中進行了詳細說明,以確保用戶能夠有效地進行數據準備。

在模型訓練與推理方面,研究團隊提供了詳細的命令行腳本,用戶可根據自身需求調整參數。團隊還特別強調了數據結構的重要性,提供了清晰的目錄結構示例,指導用戶如何準備數據。

SHMT 模型的推出,標誌着自監督學習在化妝效果遷移領域的成功應用,未來可能在美容、美妝和圖像處理等行業得到廣泛應用。這項研究不僅展示了技術的潛力,同時也爲相關領域的深入研究打下了堅實的基礎。

項目入口:https://github.com/Snowfallingplum/SHMT

劃重點:

1. 🎓 SHMT 模型利用潛在擴散模型實現化妝效果轉移,已被 NeurIPS2024接收。

2. 🔧 團隊提供完整的開源代碼和預訓練模型,便於研究人員進行應用與改進。

3. 📂 數據準備和參數調整至關重要,研究中詳細指導了操作流程和目錄結構。