2024年12月26日,中國人工智能初創公司DeepSeek發佈了其最新的超大模型DeepSeek-V3,這一模型以其開放源代碼技術和創新挑戰領先AI供應商而聞名。

DeepSeek-V3擁有671B個參數,並採用專家混合架構(mixture-of-experts architecture)來激活特定參數,以準確高效地處理給定任務。根據DeepSeek提供的基準測試,這一新模型已經超越了包括Meta的Llama3.1-405B在內的領先開源模型,並且與Anthropic和OpenAI的封閉模型性能相近。

DeepSeek-V3的發佈標誌着開源AI與封閉源AI之間的差距進一步縮小。DeepSeek,最初是中國量化對衝基金High-Flyer Capital Management的一個分支,希望這些發展能爲人工通用智能(AGI)鋪平道路,屆時模型將能夠理解或學習任何人類能夠執行的智力任務。

DeepSeek-V3的主要特點包括:

與前身DeepSeek-V2一樣,新模型基於多頭潛在注意力(MLA)和DeepSeekMoE的基本架構,確保了高效的訓練和推理。

公司還推出了兩項創新:輔助無損失負載平衡策略和多令牌預測(MTP),後者允許模型同時預測多個未來令牌,提高了訓練效率,並使模型運行速度提高三倍,每秒生成60個令牌。

在預訓練階段,DeepSeek-V3訓練了14.8T高質量和多樣化的令牌,並進行了兩階段的上下文長度擴展,最終進行了監督式微調(SFT)和強化學習(RL)的後訓練,以使模型與人類偏好對齊並進一步釋放其潛力。

在訓練階段,DeepSeek採用了多種硬件和算法優化,包括FP8混合精度訓練框架和DualPipe算法進行流水線並行,降低了訓練成本。DeepSeek-V3的整個訓練過程聲稱在2788K H800GPU小時或大約557萬美元內完成,遠低於通常用於預訓練大型語言模型的數億美元。

DeepSeek-V3已成爲市場上最強的開源模型。公司進行的多項基準測試顯示,它在大多數基準測試中超越了封閉源GPT-4o,除了以英語爲焦點的SimpleQA和FRAMES,在這兩個測試中OpenAI模型分別以38.2和80.5的得分領先(DeepSeek-V3得分分別爲24.9和73.3)。DeepSeek-V3在中文和數學基準測試中的表現尤爲突出,在Math-500測試中得分爲90.2,其次是Qwen的80分。

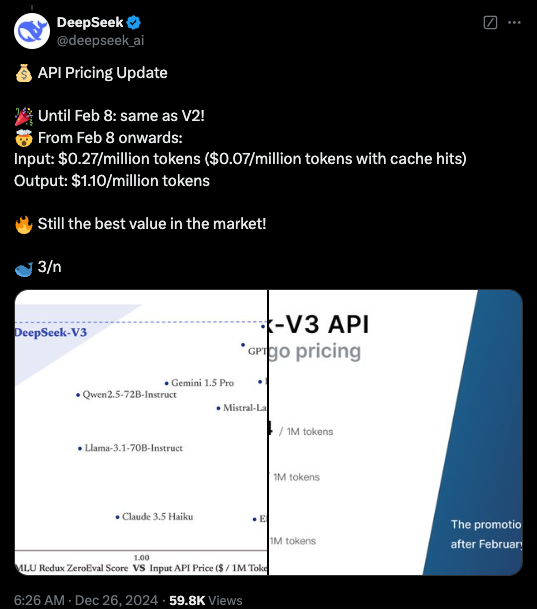

目前,DeepSeek-V3的代碼可在GitHub上以MIT許可證獲得,模型根據公司的模型許可證提供。企業還可以通過DeepSeek Chat(類似ChatGPT的平臺)測試新模型,並訪問API進行商業使用。DeepSeek將提供與DeepSeek-V2相同價格的API,直至2月8日。之後,將收取每百萬輸入令牌0.27美元(緩存命中每百萬令牌0.07美元)和每百萬輸出令牌1.10美元的費用。

劃重點:

🌟 DeepSeek-V3發佈,性能超越Llama和Qwen。

🔧 採用671B參數和專家混合架構,提高效率。

🚀 創新包括無損失負載平衡策略和多令牌預測,提升速度。

💼 訓練成本大幅降低,推動開源AI發展。