在當今快速語音合成轉換技術背景下,語音僞造日益嚴重,用戶隱私和社會安全帶來了不小的威脅。近日,浙江大學智能系統安全實驗室和清大學聯合發佈了一種新型的語音僞造檢測框架,名爲 “SafeEar”。

這一框架致力於在保護語音內容隱私的同時,實現高效的僞造檢測,充分應對語音合成帶來的。

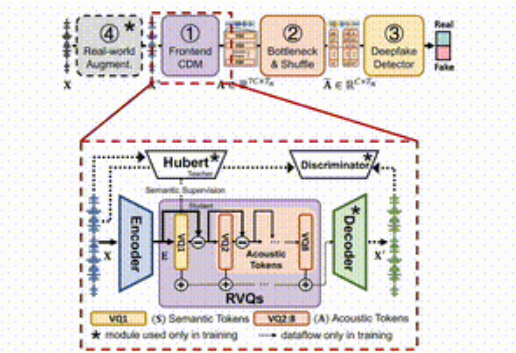

SafeEar 的思想是通過設計基於神經音頻編解碼器的解耦模型,巧妙地將語音的聲學與語義信息分離。這意味着,SafeEar 僅依賴聲學信息進行僞造檢測,而無需接觸音的完整內容,這樣就能有效防止隱私泄露。

整個框架分爲四個主要部分。

首先,前端解耦模型負責從輸入的語音中提取目標聲學特徵;其次,瓶頸層和混淆層則通過降維和打亂聲學特徵,提高了對內容竊取的抵禦能力;第三,僞造檢測器利用了 Transformer 分類器來判斷音頻是否被僞造;最後,真實環境增強模塊則通過模擬不同的音頻環境,進一步了模型的檢測。

項目入口:https://github.com/LetterLiGo/SafeEar?tab=readme-ov-file

經過在多個基準數據集上的實驗,研究團隊發現 SafeEar 的錯誤率低至2.02%。這意味着它在識別深僞音頻方面非常有效!而且,SafeEar 還能夠保護五種語言的音頻內容,使其不易被機器或人耳解析,單詞錯誤率高達93.93%。同時,通過測試,研究人員發現攻擊者無法恢復被保護的語音內容,顯示出該技術在隱私保護方面的優勢。

此外,SafeEar 團隊還構建了一個包含150萬條多語言音頻數據的數據集涵蓋了英語、中文、德語法語和意大利語等多種,爲未來的語音僞造檢測和研究提供了豐富的基礎資料。

SafeEar 的推出不僅爲語音僞造檢測領域帶來了新的解決方案,也爲保護用戶的語音隱私鋪平了道路。

劃重點:

- 🎤 **SafeEar 的創新框架 **:能夠檢測深僞音頻而不泄露語音內容,保護用戶隱私。

- 🔍 ** 多頭自注意機制 **:提升了在沒有語義線索情況下識別深僞音頻的能力,錯誤率低至2.02%。

- 🔒 ** 音頻內容保護 **:有效保障多種語言的音頻不被解析,單詞錯誤率高達93.93%。