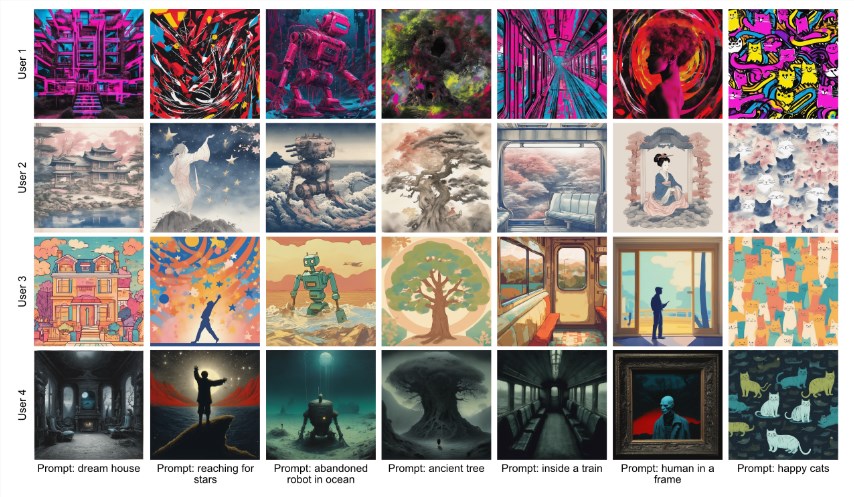

最近,瑞士洛桑聯邦理工學院的研究團隊推出了一種新方法,名爲 ViPer(Visual Personalization of Generative Models via Individual Preference Learning),旨在根據用戶的視覺偏好個性化生成模型的輸出。

這一創新在即將到來的2024年 ECCV 會議上進行了展示,團隊希望能夠讓每個用戶在相同的提示下,獲得更符合自己喜好的生成結果。

產品入口:https://top.aibase.com/tool/viper

ViPer 的工作原理非常簡單。用戶只需一次性提供自己對一組圖片的評論,這些評論將用來提取他們的視覺偏好。這樣,生成模型就能在沒有複雜提示的情況下進行個性化調整,利用這些屬性來生成符合用戶喜好的圖片。

簡單的說,這有點類似Midjourney 此前推出的個性化偏好功能(--personalize),要使用Midjourney個性化模型,用戶需要在過去對配對排名中的圖片進行過至少200次的點贊或評分。這些評分和點贊行爲幫助Midjourney學習用戶的偏好,使個性化模型能夠更準確地反映用戶的品味。

該項目的模型已經在 Huggingface 平臺上發佈,用戶可以輕鬆下載並使用。ViPer 中的 VPE 模型經過精細調整,可以從用戶提供的一系列圖像和評論中提取個體偏好。

同時,項目還提供了一種代理指標模型,能夠根據用戶喜歡和不喜歡的圖像預測某個查詢圖像的偏好分數。這意味着,用戶可以更好地瞭解自己對新圖像的潛在喜好。

另外,ViPer 還提供了代理評分機制,用戶可以通過提供喜歡和不喜歡的圖像,計算出查詢圖像的評分。這一評分從0到1不等,分數越高,表明用戶越喜歡這幅圖像。團隊建議每個用戶提供大約8張喜歡的和8張不喜歡的圖像,以確保結果的準確性。

劃重點:

🌟 ViPer 通過用戶的一次性評論提取個體視覺偏好,從而個性化生成模型的輸出。

🖼️ 該項目的模型已在 Huggingface 發佈,用戶可以方便地下載和使用。

📊 ViPer 提供代理評分機制,幫助用戶預測對新圖像的喜好程度。