歡迎來到【AI日報】欄目!這裏是你每天探索人工智能世界的指南,每天我們爲你呈現AI領域的熱點內容,聚焦開發者,助你洞悉技術趨勢、瞭解創新AI產品應用。

新鮮AI產品點擊瞭解:https://top.aibase.com/

1、微信接入DeepSeek 騰訊迴應:不會使用用戶個人信息和隱私數據

近期,微信在搜索功能上進行了創新,開始灰度測試接入DeepSeek R1模型,旨在提升用戶的AI搜索體驗。騰訊確認,參與測試的用戶將能夠免費使用該模型,享受更豐富的搜索服務。新功能的推出標誌着微信在搜索技術上的重要進展,同時騰訊也承諾不會使用用戶的個人信息,確保用戶隱私得到保護。

【AiBase提要:】

🧠 微信搜一搜引入DeepSeek R1模型,提升AI搜索能力,用戶可享受更智能的搜索體驗。

🔒 騰訊承諾在AI搜索中不使用用戶個人信息,保障用戶隱私安全。

🌐 多個騰訊產品正在探索接入DeepSeek模型,提供更穩定和全面的搜索服務。

2、百度搜索:將全面接入DeepSeek及文心深度搜索功能

百度搜索近期宣佈全面接入DeepSeek和文心大模型的深度搜索功能,旨在提升用戶的搜索體驗。文心大模型的深度搜索功能已於2月13日上線,具備多模態輸入輸出能力,能夠提供專家級內容回覆。與此同時,百度文心智能體平臺也將接入DeepSeek,以便爲開發者提供更便利的模型調用途徑。

【AiBase提要:】

🚀 文心大模型的深度搜索功能已於2月13日上線,提供多元化的搜索服務。

💡 開發者將通過百度文心智能體平臺接入DeepSeek,簡化智能體創建與優化。

📅 文心一言將於4月1日起全面免費開放,未來幾個月內還將推出新版本。

3、開發者狂喜!字節AI編程工具Trae正式發佈Win x64版本

字節AI編程工具Trae的Win x64版本正式發佈,標誌着其在開發者工具領域的又一重要進展。這一更新旨在爲用戶提供更流暢的操作體驗,進一步提升開發效率。Trae的Builder模式通過與AI的對話簡化任務執行,結合多模態功能和智能自動補全,極大地優化了開發過程,幫助開發者更專注於創作。

【AiBase提要:】

🚀 Trae現已支持Win x64版本,爲用戶提供更流暢的操作體驗。

🤖 Builder模式允許用戶與AI對話,自動拆解和執行任務,提升工作效率。

💡 先進的智能自動補全功能實時預測用戶意圖,顯著提高開發效率。

詳情鏈接:https://www.trae.ai/

4、馬斯克宣佈 xAI 將推出 Grok3,稱其爲 “地表最強AI模型”

在全球人工智能競爭加劇的背景下,億萬富翁埃隆·馬斯克創辦的人工智能公司xAI即將發佈其最新的Grok3聊天機器人。馬斯克稱Grok3爲“地球上最聰明的AI”,並強調其超越現有市場競爭工具的能力。Grok3具備反思自身錯誤的能力,能夠通過分析數據實現邏輯一致性。

【AiBase提要:】

🌟 馬斯克將於本週一發佈Grok3聊天機器人,稱其爲“地球上最聰明的AI”。

💡 Grok3具備反思自身錯誤的能力,並超越當前市場上所有競爭工具。

🚀 全球多個國家加速推出AI聊天機器人,市場競爭愈發激烈。

5、UI設計神器!Ready AI:輸入提示詞即可生成專業級網頁

Ready AI是一款引人注目的工具,允許用戶通過簡單的文字指令在短短30秒內生成專業級的網頁界面。其獨特之處在於提供實時預覽和版本對比功能,使得設計過程更加高效。用戶可以自由選擇框架、顏色風格和佈局結構,甚至可以上傳圖片作爲靈感。

【AiBase提要:】

🚀 文字指令秒出雙版本設計:支持A/B方案對比與歷史版本回溯

🛠️ 前端界面生成利器:需配合編程工具實現完整功能

💵 階梯式收費方案:免費版可生成10個完整頁面

詳情鏈接:https://readdy.ai/home

6、QQ瀏覽器接入DeepSeek-R1滿血版 支持微信公衆號等實時聯網搜索

QQ瀏覽器於2月16日正式接入DeepSeek-R1模型滿血版,旨在爲用戶提供更智能、便捷的搜索體驗。新模型具備深度思考、聯網搜索、多輪對話及歷史記錄回溯等功能,確保用戶獲得全面且高質量的回答。此外,用戶在手機端和電腦端均可輕鬆訪問該功能,提升了搜索的精準度和效率。

【AiBase提要:】

🔗 接入DeepSeek-R1模型,增強搜索體驗,支持多輪對話和歷史記錄回溯。

📱 用戶可在手機端和電腦端使用DeepSeek模型,提供實時聯網搜索,包括微信公衆號信息。

📝 提供記筆記和正文提取功能,支持多種格式導出,提升信息處理效率。

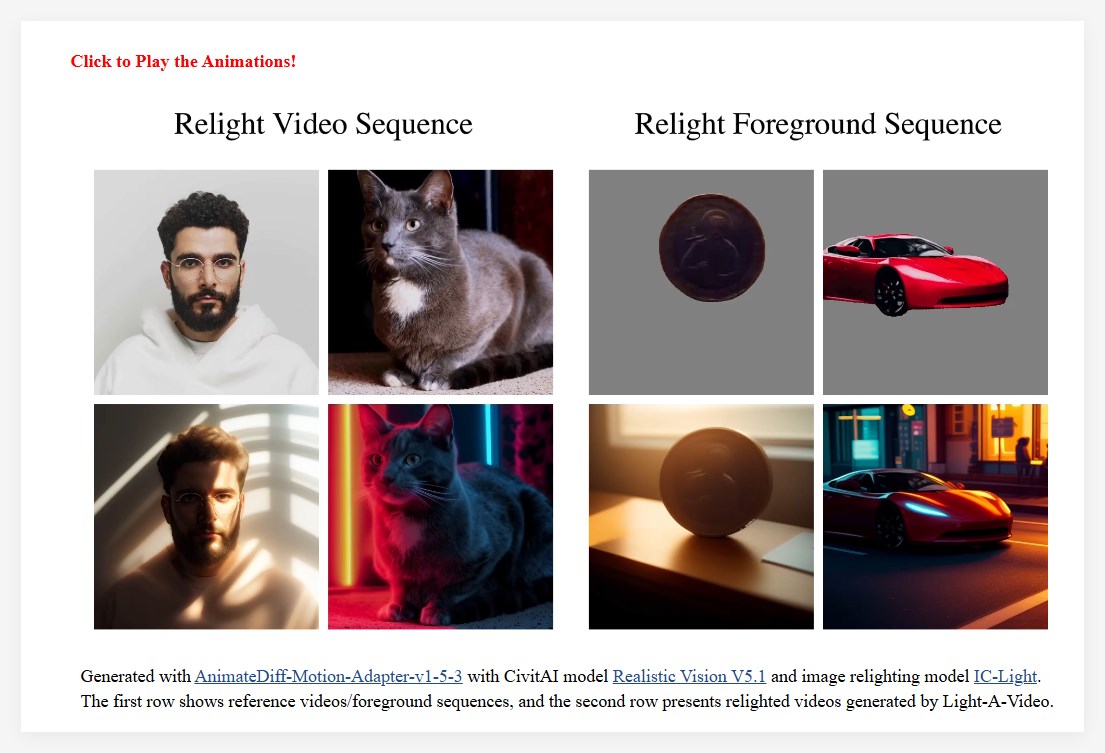

7、Light-A-Video :無需訓練實現視頻重新打光

Light-A-Video是一項創新技術,旨在解決視頻重光照中的時間一致性問題。通過引入一致光注意力模塊和漸進光融合策略,該方法能夠有效處理光源不一致的問題,顯著提升視頻質量和時間一致性。實驗結果表明,Light-A-Video不僅保持了圖像的高質量,還確保了跨幀光照的平滑過渡,爲視頻重光照領域的未來研究提供了新的方向。

【AiBase提要:】

🌟 Light-A-Video 是一種無需訓練的技術,旨在實現視頻重光照的時間一致性。

🎥 採用一致光注意力模塊和漸進光融合策略,解決了視頻重光照中的光源不一致問題。

📈 實驗表明,Light-A-Video 顯著提高了重光照視頻的時間一致性與圖像質量。

詳情鏈接:https://bujiazi.github.io/light-a-video.github.io/

8、Meta 出品!Pippo:輸入單張人物圖片生高分辨率多視角圖片

Meta Reality Labs 最近推出的 Pippo 模型是一項突破性技術,能夠從一張普通照片生成高達1K分辨率的多視角視頻。這一創新不需要額外的輸入參數,用戶只需提供一張照片,系統便能自動生成生動的立體效果。爲了方便開發者,Pippo 以代碼-only 版本發佈,用戶可以自行訓練模型並進行應用。

【AiBase提要:】

🌟 Pippo 模型能夠從一張普通照片生成高分辨率的多視角視頻,無需額外輸入。

💻 代碼僅發佈,沒有預訓練權重,開發者可自行訓練模型並進行應用。

🔍 團隊計劃未來推出更多功能和改進,以增強用戶體驗。

詳情鏈接:https://github.com/facebookresearch/pippo

9、微軟發佈 OmniParser V2.0:把屏幕截圖轉化成LLM可處理的結構化格式

微軟推出的 OmniParser V2.0是一款新型解析工具,旨在將用戶界面截圖轉化爲結構化數據,從而提升基於大型語言模型的用戶操作體驗。該工具通過改進的數據集和算法,顯著提高了圖標識別的準確性和處理速度,使用戶在操作虛擬機時更加高效。

【AiBase提要:】

🔍 OmniParser V2.0能將 UI 截圖轉換爲結構化信息,提升用戶操作體驗。

⚡ 新版本平均延遲減少至0.6秒/幀,準確率達39.6%。

🔐 使用時需注意輸入內容的安全性,開發者應遵循安全標準與倫理規範。

詳情鏈接:https://huggingface.co/microsoft/OmniParser-v2.0

10、月之暗面解密o1:Long-CoT是關鍵,模型思考需要放長線

月之暗面研究員Flood Sung在長文中深入探討了k1.5模型的研發思路及OpenAI o1模型的技術啓示。文章強調了Long-CoT(長鏈條思維)的重要性,指出其在小型模型訓練中的應用效果顯著。儘管之前因成本考慮將重點放在Long Context的優化上,但OpenAI o1的發佈促使團隊重新審視技術方向,決定全面推進Long-CoT研究,以期實現更接近人類的思考能力。

【AiBase提要:】

🌟 Long-CoT被證明在小型模型訓練多位數運算中具有顯著效果,強調了其在輸出端的重要性。

💡 OpenAI o1的發佈促使月之暗面重新審視技術優先級,認爲性能突破是首要目標。

🔍 月之暗面開始系統性對標o1模型,致力於在相關領域展開實質性研究。

詳情鏈接:https://mp.weixin.qq.com/s/sJmT-tM3A-mglZ1d4OI80A

11、80%準確率!Meta 研發出無創腦機接口,僅憑思維就能打字

Meta最近開發了一種無創腦機接口設備,能夠通過讀取人腦的神經信號實現文字輸入。該技術利用磁腦電圖(MEG)掃描儀和深度學習AI模型,成功解碼打字時的腦電信號,重建完整句子。儘管設備重達近半噸、價格高達200萬美元,並需在特殊環境中使用,當前準確率已達80%。

【AiBase提要:】

🧠 Meta開發的無創腦機接口設備可通過腦信號實現文字輸入。

💰 該設備重達半噸,價格高達200萬美元,且需在特殊環境中使用。

📊 目前準確率爲80%,但仍需改進,距離實際應用還有一定距離。