人工知能技術の発展に伴い、動画理解の重要性が増しています。この背景から生まれたVideoLLaMA2プロジェクトは、動画の大規模言語モデルにおける時空間モデリングと音声理解能力の向上を目指しています。このプロジェクトは高度なマルチモーダル言語モデルであり、ユーザーが動画の内容をより深く理解するのに役立ちます。

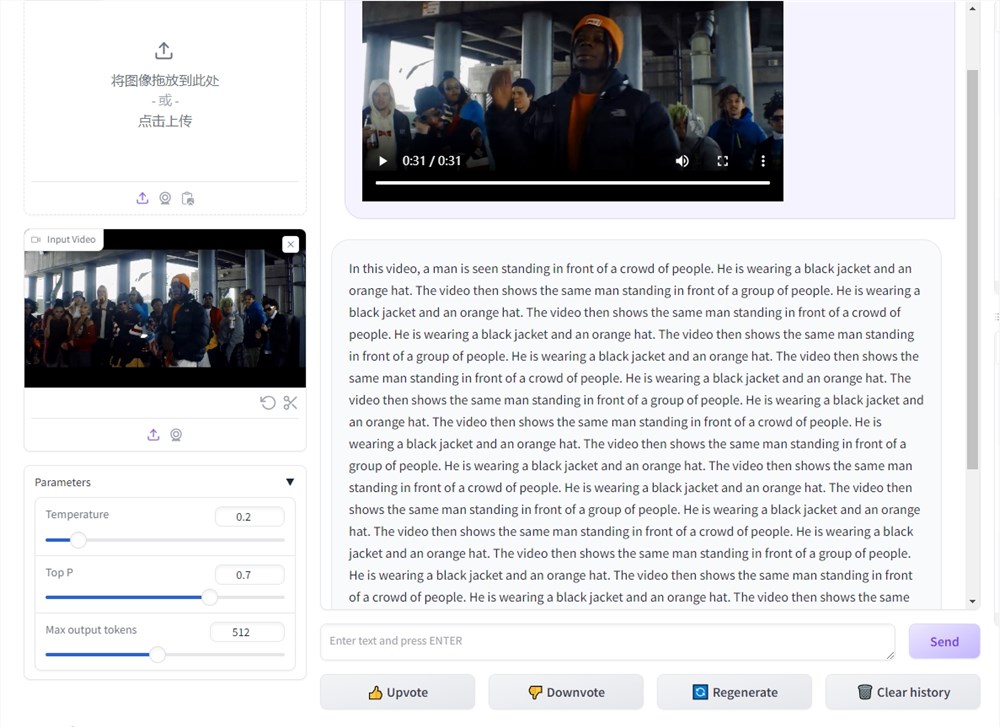

テストでは、VideoLLaMA2は動画の内容を非常に高速に認識します。例えば、31秒の動画であればわずか19秒で認識し、字幕を生成します。下記動画の字幕は、VideoLLaMA2が指示に基づいて動画を理解した結果です。

動画字幕の大意:この動画は、活気に満ちた想像力豊かなシーンをとらえています。小さな海賊船が、コーヒーの泡立つ波間を航海しています。精巧に作られた船は、帆を張り、旗を翻し、泡の海を冒険しているようです。船には詳細な索具とマストがあり、現実味を増しています。全体として、この見事な光景は、一杯のコーヒーの中に収まった、楽しく想像力豊かな海の冒険を描写しています。

現在、VideoLLaMA2の公式試用版が公開されています。下記はスクリーンショットです。

VideoLLaMA2プロジェクトへのアクセス:https://top.aibase.com/tool/videollama-2

試用URL:https://huggingface.co/spaces/lixin4ever/VideoLLaMA2

VideoLLaMA2 の機能:

1. 時空間モデリング: VideoLLaMA2は正確な時空間モデリングを行い、動画内の動作やイベントの順序を認識します。動画の内容をモデル化することで、動画のストーリーをより深く理解することができます。

時空間モデリングとは、モデルが動画内の時間と空間情報を正確に捉え、動画で発生するイベントや動作の順序を推論できることを意味します。この機能により、動画の内容理解がより正確かつ詳細になります。

2. 音声理解: VideoLLaMA2は優れた音声理解能力も備えており、動画内の音声内容を認識・分析できます。これにより、ユーザーは視覚情報だけでなく、動画の内容をより包括的に理解できます。

音声理解とは、モデルが動画内の音声、例えば音声会話や音楽などを認識・分析できることを意味します。音声理解により、ユーザーは動画の背景音楽や会話内容などをよりよく理解し、動画をより包括的に理解することができます。

VideoLLaMA2 の応用事例:

上記の機能に基づき、VideoLLaMA2はリアルタイムでのハイライト生成、リアルタイムのライブ配信内容の理解と要約などに利用できます。以下に要約します。

動画理解研究:学術分野では、VideoLLaMA2は動画理解研究に使用され、研究者が動画の内容を分析し、動画のストーリーの背後にある情報を探求するのに役立ちます。

メディアコンテンツ分析:メディア業界では、VideoLLaMA2を使用して動画コンテンツを分析し、ユーザーニーズをより深く理解し、コンテンツ推奨などを最適化することができます。

教育とトレーニング:教育分野では、VideoLLaMA2を使用して教育動画を作成し、教育内容の理解を支援し、学習効果を高めることができます。