最近、Character AI はユーリー大学の研究チームと共同で、Ovi という新しい音声と映像を同期させる動画生成技術をリリースしました。このオープンソースプロジェクトは、音声と映像生成技術における大きな進展であり、従来の音声と映像生成の方法を打破しています。

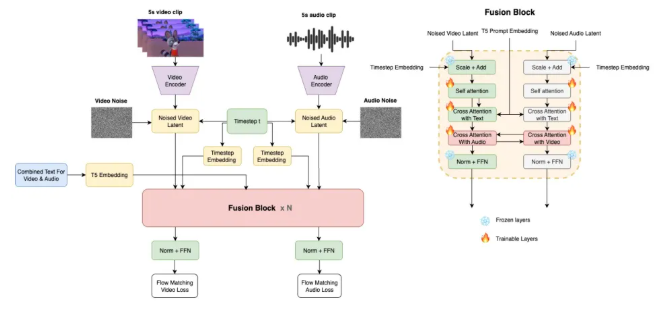

Ovi は、音声と映像を分離できない全体として扱う、革新的な二本の骨格間クロスモーダル融合アーキテクチャを採用しています。このシステムでは、音声と映像の処理プロセスが並列に行われ、お互いに深くやり取りすることで、音声と映像の完璧な同期を実現します。このデザイン思想により、以前の「まず画像を生成してから音声を追加する」またはその逆の方法とは異なり、音声と映像の非同期問題を解決しました。

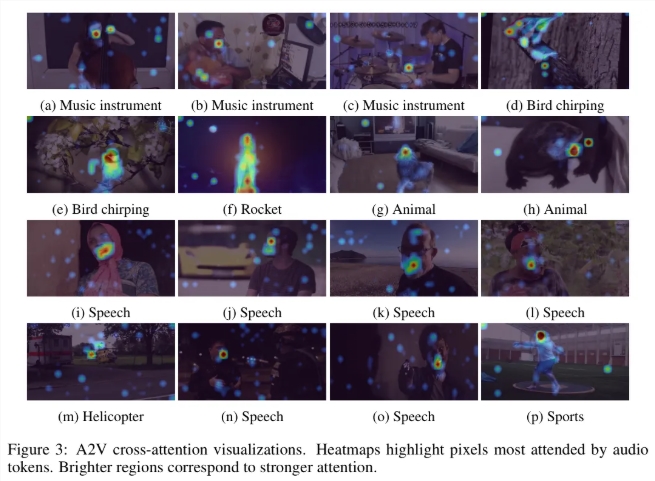

Ovi のアーキテクチャには、動画と音声をそれぞれ処理する機能が同じ2つのブランチがあります。これらのブランチは同じ拡散トランスフォーマー構造を使用しており、音声と映像が生成中に直接対話できるため、不要なパラメータや計算コストを削減できます。このようなリアルタイムでの情報交換により、Ovi は音声と映像の正確な関係性、例えば唇の動きと発音の正確なマッチングを正確に学習することができます。

音声と映像の時間的な正確な同期を確保するために、Ovi は「回転位置埋め込み」という技術を導入しています。数学的スケーリングによって、音声と映像の時間ステップポイントが完全に一致し、生成過程で両者が同期して表示されるようにします。また、ユーザー入力の処理においても、統一されたテキストヒント戦略を使用し、生成結果の精度と豊かさを高めています。

データセットの構築において、Ovi チームは複雑な処理プロセスを設計し、トレーニングデータの多様性と高品質を確保しました。彼らは音声と映像のペアのデータセットと純粋な音声データセットを組み合わせ、モデルに包括的な学習基盤を提供しました。この厳密なトレーニング計画は、Ovi の成功に不可欠な基礎を築きました。

github:https://github.com/character-ai/Ovi

重要なポイント:

🌟 Ovi は、Character AI とユーリー大学が共同開発したオープンソースの音声と映像を同期させる動画生成技術です。

🎥 二本の骨格間クロスモーダル融合アーキテクチャを採用し、音声と映像のリアルタイムでの対話と完璧な同期を実現しています。

📊 チームは高品質で多様なデータセットを構築し、Ovi のトレーニングと応用をサポートしています。