技術の波に乗り、TikTok SAILチームとLV-NUS Labが強力なパートナーシップを結び、SAIL-VL2というマルチモーダル大規模モデルを発表しました。この新しいモデルは、比較的小さなパラメータ数を維持しながらも、複雑な推論タスクで多くの同種モデルを上回り、より大きな閉鎖型モデルとも対等に競えることを示しています。この画期的な進展は、小規模モデルの応用可能性を大きく広げました。

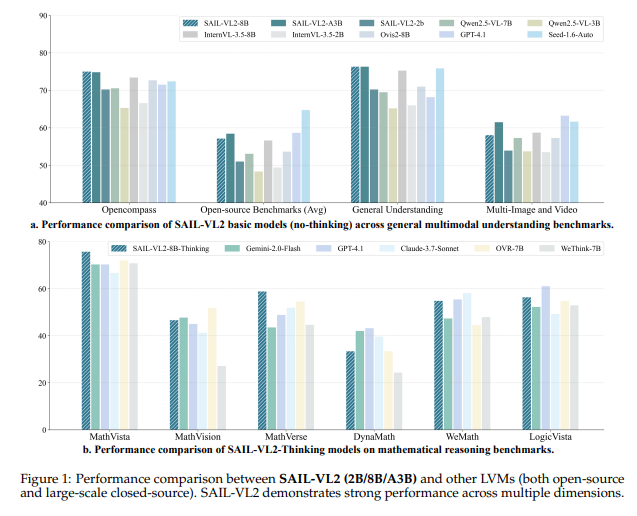

SAIL-VL2のパラメータ設定は2Bと8Bがあり、106のデータセットで性能の突破を達成し、特にMMMUやMathVistaなどの複雑な推論ベンチマークテストにおいて優れた成果を収めています。このモデルは、「小さなモデルでも強力な能力を持つことができる」という新たなパターンを示しています。それを実現するために、SAIL-VL2はデータ、トレーニング、アーキテクチャ設計の3つの面で革新を施しました。

アーキテクチャ設計では、SAIL-VL2はスパース混合エキスパート(MoE)を取り入れて、性能と計算効率を最適化しています。視覚エンコーダーであるSAIL-ViTは段階的な最適化を行い、徐々に視覚と言語の整合性を高めていきます。この革新的な設計により、SAIL-VL2は推論時に一部のパラメータのみをアクティブ化することで、モデルの計算効率を大幅に向上させています。

データ面では、SAIL-VL2は高品質なマルチモーダルコールバックを構築し、スコアフィルタリングや合成拡張を活用して、データの正確性と多様性を確保しています。また、チームは段階的なトレーニングフレームワークを開発し、基本的な認識から複雑な推論へと段階的に移行するように設計しており、これによりモデルのさまざまなタスクにおけるパフォーマンスが向上しています。

全体的なプロセスの最適化を通じて、SAIL-VL2はベースモデルの性能で顕著な進展を遂げました。データによると、このモデルは多数のベンチマークテストで突出した結果を収め、8B規模のモデルは最新のGPT-4oと同等の推論能力を持っていることが確認されています。このような進展は、研究界に新たな希望をもたらすだけでなく、今後のマルチモーダルモデルの応用への道を開きました。

SAIL-VL2のオープンソースコードとモデルもGitHubとHugging Faceで公開されており、研究者や開発者が利用しやすく、深く探求できるようになっています。学術研究や産業応用においても、SAIL-VL2は強い潜在力と応用の可能性を示しています。