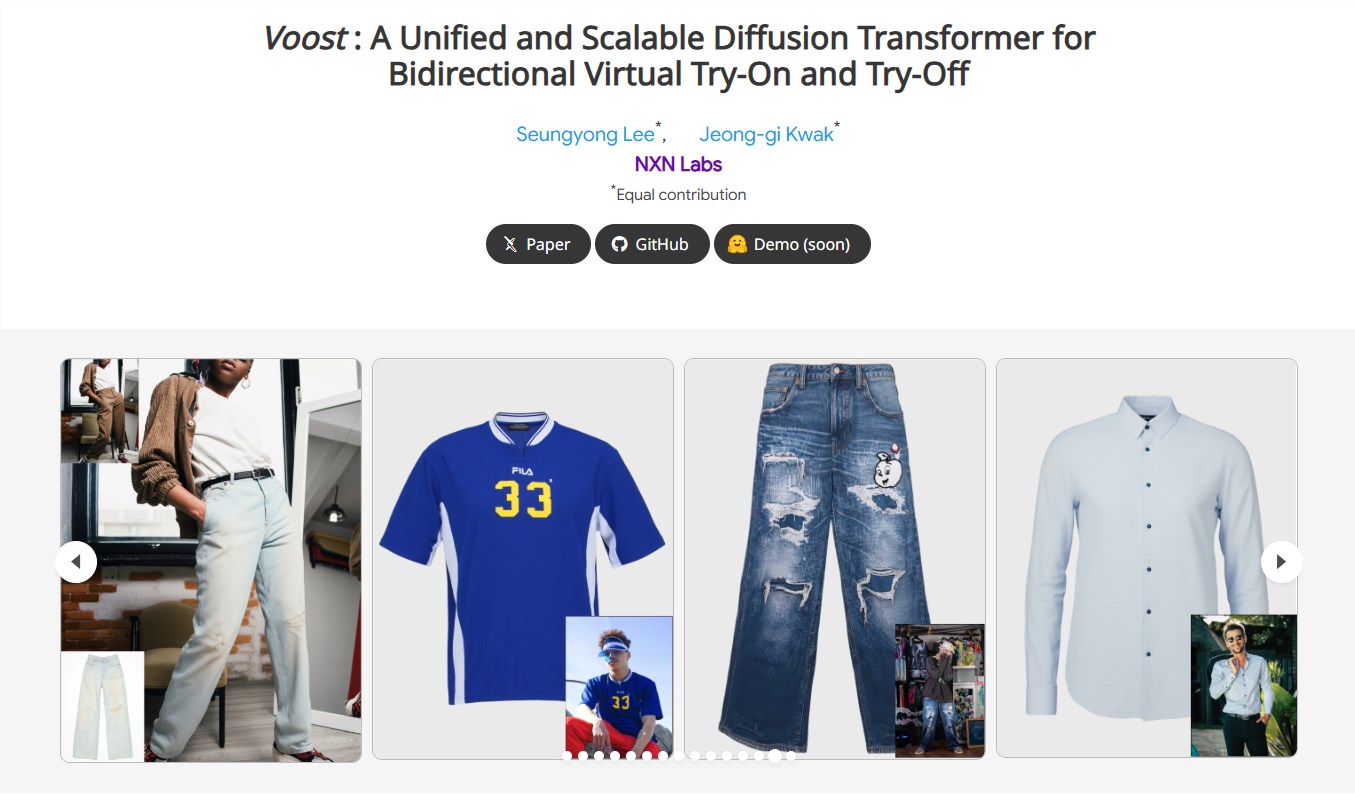

最近、研究者は「Voost」という革新的なフレームワークを提案し、仮想試着や仮想脱ぎ技術の性能を向上させることを目的としています。仮想試着とは、ある人物が目的の服を着たリアルな画像を合成することですが、姿勢や外見の変化により、服と体の対応関係を正確にモデル化することが大きな課題でした。Voostの登場により、この問題に対する新たな解決策が提示されました。

Voostは、統一的で拡張可能なモデルであり、一つの単一の拡散変換器(DiT)を通じて仮想試着と仮想脱ぎのタスクを同時に学習します。従来の方法とは異なり、Voostは各ペアの服と人に対して双方向の監督を行うことができ、特定のタスク用のネットワークや補助損失、追加のラベルに依存することなく、服と体の関係性の推論を強化します。この特徴により、Voostはタスクの柔軟性と生成の多様性において優れた性能を発揮します。

さらに、研究チームは推論時にモデルの耐障害性を向上させるための2つの技術を導入しました。一つは注意温度スケーリング技術で、解像度やマスクの変化がある場合でもモデルの安定性を保つことができます。もう一つは自己修正サンプリングで、タスク間の双方向的一貫性を利用して生成結果をさらに最適化します。これらの革新技術により、Voostは異なる入力状況に適応しながら推論を行うことが可能です。

多数の実験では、Voostは優れた性能を示し、仮想試着および仮想脱ぎのベンチマークテストで最新のレベルに達しました。研究結果によると、Voostは整列の正確性、視覚的な現実性、一般化能力など複数の面で多くの強基線モデルを顕著に上回っています。この成果は、仮想試着および仮想脱ぎ技術の発展に新たな方向性を提供するだけでなく、今後の関連分野の研究にも基盤を築くものです。

Voostの成功は、深層学習技術が服の試着体験における潜在能力を示しており、デジタルファッションやオンラインショッピングの分野で新しい変化が訪れることを予告しています。

プロジェクト:https://nxnai.github.io/Voost/

ポイント:

🌟 Voostは、一つの拡散変換器を用いて仮想試着と仮想脱ぎを共同で学習する新しいフレームワークです。

🔍 Voostは、タスクの柔軟性と生成の多様性に優れており、特定のネットワークや追加のラベルを必要としません。

🚀 実験結果によると、Voostは現在の多くの強基線モデルよりも正確性と視覚品質で優れています。