近日,阿里巴巴通義實驗室宣佈開源其最新研發成果——ViDoRAG,這是一款專爲視覺文檔理解設計的檢索增強生成(RAG)系統。ViDoRAG在GPT-4o模型上的測試顯示,其準確率達到了令人矚目的79.4%,相較傳統RAG系統提升了10%以上。這一突破標誌着視覺文檔處理領域邁出了重要一步,爲人工智能在複雜文檔理解上的應用提供了新的可能性。

多智能體框架賦能視覺文檔理解

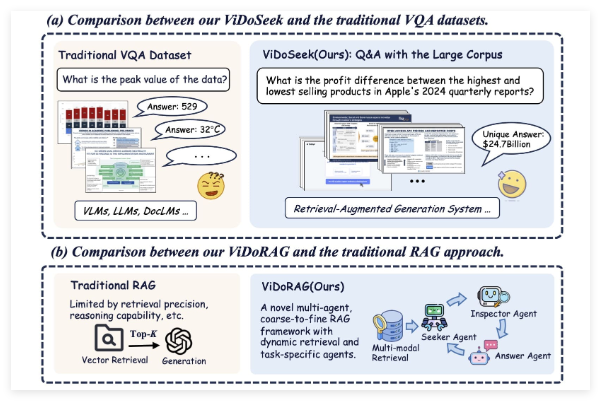

ViDoRAG並非傳統的單一模型,而是採用了創新的多智能體框架設計。據介紹,該系統結合了動態迭代推理代理(Dynamic Iterative Reasoning Agents)和基於GMM(高斯混合模型)的混合檢索技術。這種方法使得ViDoRAG能夠在處理包含圖像和文本的視覺文檔時,更加精準地提取和推理關鍵信息。相比傳統RAG系統僅依賴文本檢索的侷限性,ViDoRAG通過多模態數據融合顯著提升了性能。

通義實驗室在發佈的論文和代碼倉庫中詳細描述了ViDoRAG的工作原理。其核心在於通過多個智能體協作,動態調整檢索和生成的過程,從而在複雜場景下減少“幻覺”現象(即模型生成不準確或憑空捏造的內容),並提高回答的可靠性和上下文相關性。

性能突破:準確率提升10%以上

該系統在GPT-4o上的準確率達到79.4%,這一數字不僅展示了其優異性能,還將其與傳統RAG系統進行了對比。傳統RAG系統雖然在文本生成任務中表現出色,但在處理視覺文檔時往往受限於單一模態的檢索能力,準確率通常徘徊在較低水平。而ViDoRAG通過引入視覺信息與文本信息的深度整合,將準確率提升了超過10個百分點。這一進步對於需要高精度文檔理解的場景,如法律文件分析、醫療報告解讀和企業數據處理,具有重要意義。

阿里巴巴通義實驗室將ViDoRAG開源的舉措也在Twitter上引發了熱議。用戶認爲,這一系統的公開不僅體現了阿里在AI領域的技術實力,也爲全球開發者和研究人員提供了一個寶貴的資源。通過公開論文和代碼(相關鏈接已在Twitter帖子中分享),ViDoRAG有望加速視覺文檔RAG技術的研究與應用,推動多模態AI系統的進一步發展。

ViDoRAG的發佈和開源無疑爲RAG技術開闢了新的方向,隨着視覺文檔處理需求的不斷增長,ViDoRAG的出現或許只是一個開始,未來我們可能會看到更多類似的創新系統涌現。

項目:https://github.com/Alibaba-NLP/ViDoRAG