隨着全球化的不斷深入,神經機器翻譯(NMT)技術在跨語言交流中扮演着越來越重要的角色。儘管目前的翻譯工具在處理技術文檔和簡單文本時表現出色,但在文學文本的翻譯上依然面臨諸多挑戰。文學作品中常常包含隱喻和比喻等富有文化和情感內涵的表達方式,傳統的翻譯系統往往難以準確傳達其深層含義。

爲了彌補這一不足,騰訊研究團隊推出了名爲 DRT-o1的新型翻譯系統。該系統包含兩個版本:DRT-o1-7B 和 DRT-o1-14B。這兩款模型基於 Qwen2.5進行構建,並引入了一種全新的多代理框架,專門針對隱喻和比喻的翻譯進行優化。研究團隊從古登堡項目中收集了約400本公共領域的英語書籍,提取了577,600個句子,並篩選出63,000個包含比喻和隱喻的句子,以作爲訓練數據。

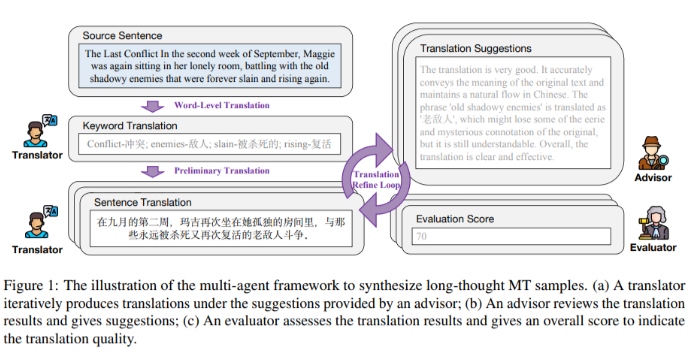

DRT-o1系統採用了一個由三種角色組成的協作方法:翻譯者、顧問和評估者。這個多代理框架的工作流程始於對源句中關鍵術語的識別和逐個翻譯,確保語境的準確性。生成初步翻譯後,經過多輪的改進與評估,最終形成流暢且易於理解的譯文。該系統在翻譯文學作品時,能夠更好地捕捉其文化內涵和情感細膩之處。

實驗結果顯示,DRT-o1-7B 的 BLEU 得分提高了8.26分,COMET 得分提高了3.36分,優於其前身 Qwen2.5-7B-Instruct。DRT-o1-14B 同樣表現出色,BLEU 得分提升了7.33分,COMET 得分提升了1.66分。這些結果表明,DRT-o1在文學翻譯中的表現超越了現有模型,尤其是其7B 版本甚至超越了更大的 QwQ-32B 模型。

DRT-o1系統通過引入多代理框架和長鏈推理方法,爲神經機器翻譯領域帶來了突破性的進展。它不僅提升了翻譯的準確性和流暢度,更爲複雜文學文本的翻譯提供了新的解決方案。

項目入口:https://github.com/krystalan/DRT-o1

劃重點:

🌟 DRT-o1系統包含兩種版本(7B 和14B),採用多代理框架優化隱喻和比喻的翻譯。

📚 研究團隊從400本公共領域書籍中提取並篩選了63,000個文學句子作爲訓練數據。

🚀 DRT-o1在 BLEU 和 COMET 得分上均顯著提升,展現出強大的文學翻譯能力。