近期,趣丸科技發佈了名爲MaskGCT的全新語音合成(TTS)模型,該模型在語音質量、相似度和可控性方面取得了顯著突破,直接顛覆了傳統語音合成(TTS)的玩法,讓AI徹底擺脫了對人工標註的依賴,實現了真正意義上的“自學成才”。

傳統的TTS系統,就像一個被溺愛的孩子,必須得人工一字一句地教它說話,先把文本和語音對齊,再預測每個音節的時長,最後才能磕磕絆絆地合成語音。這種方式,不僅效率低,而且生成的語音也缺乏自然流暢的韻律。

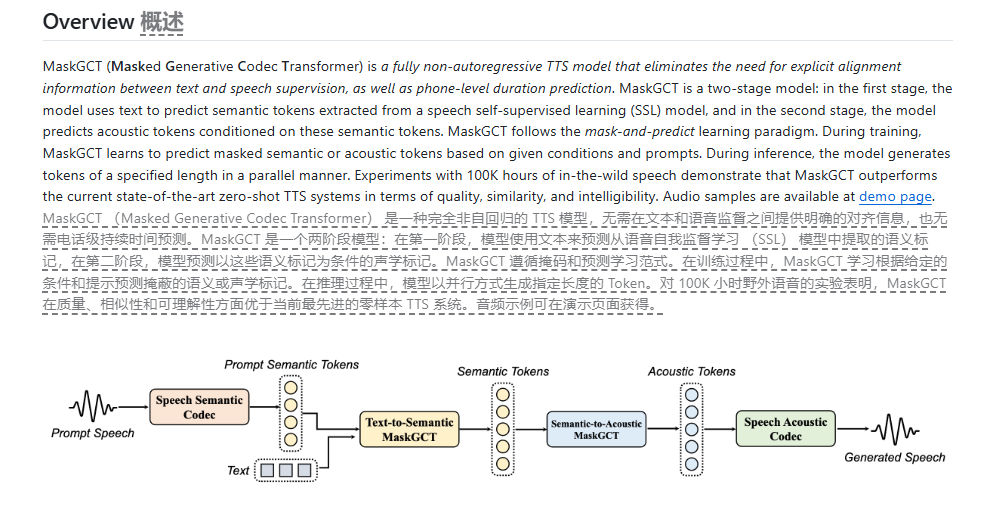

而趣丸科技這次祭出的MaskGCT,則完全拋棄了這種老舊的模式。它採用了掩碼生成式編解碼器Transformer的架構,簡單來說,就是用一個類似BERT的模型,先把語音轉換成語義特徵,再根據這些語義特徵,用另一個模型預測聲學特徵,最後合成語音。

這套玩法,最大的亮點就在於它完全不需要人工標註。它直接用10萬小時的未標註語音數據進行訓練,讓模型自己從海量數據中學習文本和語音之間的對應關係。

這就好比,把一個孩子扔到語言環境裏,讓他自己去摸索學習,最終自然而然地掌握語言。

MaskGCT的另一個牛逼之處在於,它可以像人一樣靈活地控制語音的時長,想快就快,想慢就慢。這對於需要進行配音或語音編輯的場景來說,簡直是福音。

實驗結果也證明了MaskGCT的實力。在語音質量、相似度、韻律和清晰度方面,它都吊打了現有的各種TTS系統,甚至達到了可以跟真人媲美的水平。

更可怕的是,MaskGCT不僅能生成高質量的語音,還能模仿不同說話者的風格,甚至可以跨語言進行語音翻譯,簡直就是一個六邊形戰士。

當然,MaskGCT目前還有一些侷限性,比如在處理大幅度面部姿勢的語音合成時,可能會出現一些瑕疵。但瑕不掩瑜,MaskGCT的出現,無疑爲TTS領域開闢了新的天地,也爲我們未來的人機交互體驗帶來了無限的想象空間。

在線體驗:https://huggingface.co/spaces/amphion/maskgct

項目地址:https://github.com/open-mmlab/Amphion/tree/main/models/tts/maskgct

官網地址:https://voice.funnycp.com/