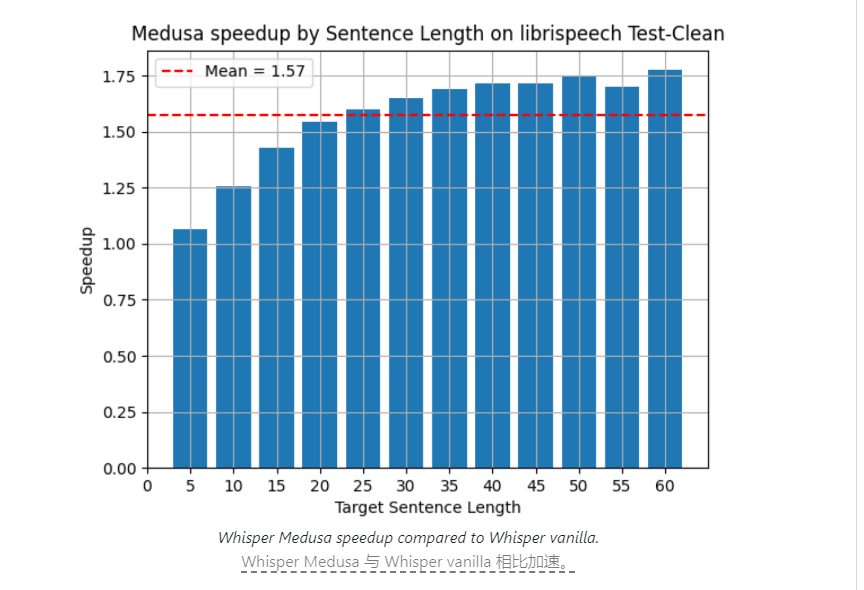

以色列人工智能公司 aiOla 近日在語音識別技術領域取得重大突破,推出了名爲 Whisper Medusa 的開源語音識別模型。這款新模型的處理速度比 OpenAI 的 Whisper 模型快50%,引起了業界廣泛關注。

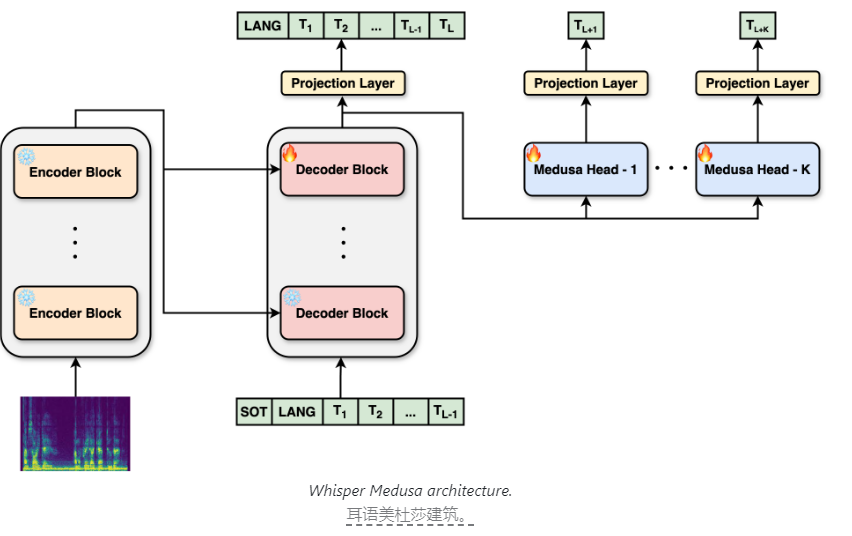

Whisper Medusa 的核心創新在於其改進的架構設計。aiOla 公司對 Whisper 的原有架構進行了修改,引入了多頭注意力機制。這一機制允許模型通過並行使用多個"注意力頭",同時關注來自不同表示子空間的信息。這種創新使得模型能夠每次預測十個 tokens,而不是傳統的一次預測一個 token,從而顯著提高了語音預測速度和生成運行時間。

值得注意的是,Whisper Medusa 在提高速度的同時並未犧牲性能。這得益於其主幹系統仍然建立在 Whisper 的基礎之上,保證了模型的準確性和穩定性。在訓練過程中,aiOla 採用了一種稱爲弱監督的機器學習方法。具體而言,他們凍結了 Whisper 的主要組件,並使用模型生成的音頻轉錄作爲標籤來訓練其他 token 預測模塊。這種創新的訓練方法進一步提高了模型的學習效率和準確性。

Whisper Medusa 的開源發佈可能對語音識別技術的發展產生深遠影響。它不僅爲研究人員和開發者提供了一個強大的新工具,還可能推動更快速、更高效的語音處理應用的發展。在日益增長的語音交互需求背景下,這一技術突破無疑將爲人工智能在語音識別領域的應用開闢新的可能性。

隨着 Whisper Medusa 的推出,我們可以期待看到更多基於此模型的創新應用,從智能助手到實時翻譯,再到語音控制系統,都可能因此獲得顯著的性能提升。這一進展不僅標誌着語音識別技術的一個重要里程碑,也爲人工智能與人類交互的未來描繪了一幅更加高效、流暢的藍圖。

項目地址:https://github.com/aiola-lab/whisper-medusa

huggingface:https://huggingface.co/aiola/whisper-medusa-v1