2025年6月29日、アリババ国際AIチームは新しく多モーダル大規模モデル「Ovis-U1」を正式に公開し、これにより多モーダル人工知能分野での新たな重要な進展を果たしました。Ovisシリーズの最新作であるOvis-U1は、多モーダル理解、画像生成、画像編集の機能を統合しており、強力なマルチモーダル処理能力を示し、開発者、研究者、業界応用に対して新たな可能性を提供しています。以下はAIbaseによるOvis-U1に関する詳細な報道です。

Ovis-U1: 三つに一体化した多モーダル統一フレームワーク

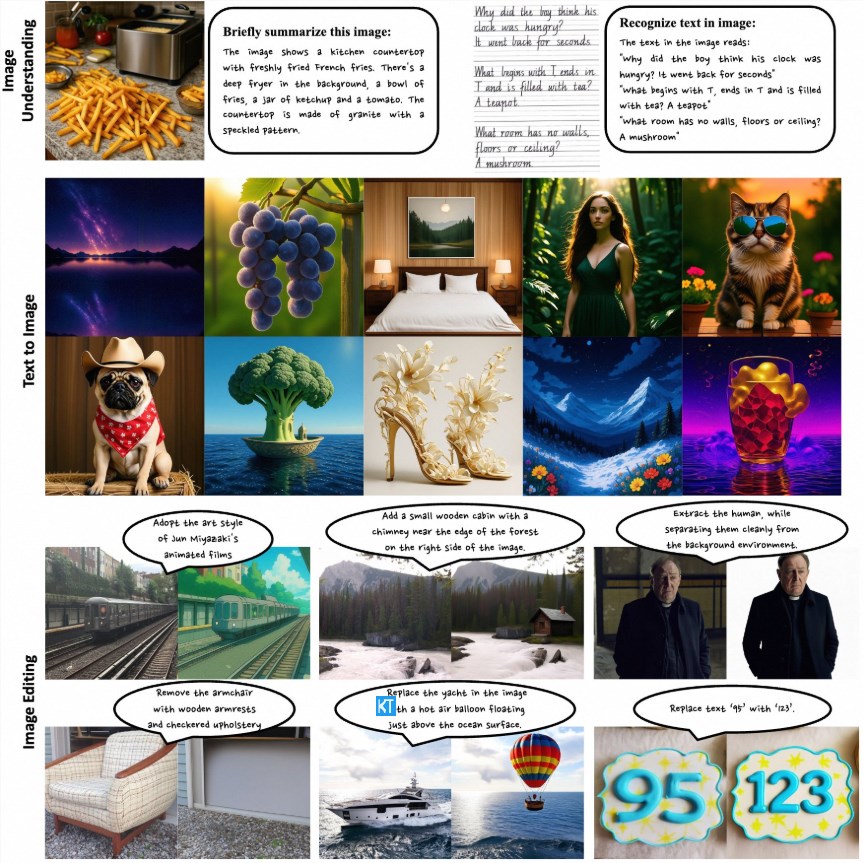

Ovis-U1は、アリババ国際AIチームがOvisシリーズのアーキテクチャに基づいて構築した3億パラメータのモデルであり、初めて多モーダル理解、テキストから画像生成、画像編集の統一を実現しました。AIbaseによると、このモデルは画期的なアーキテクチャ設計を採用しており、視覚トークナイザ(Visual Tokenizer)、視覚埋め込み表、そして大規模言語モデル(LLM)という3つの主要なコンポーネントを通じて、視覚とテキストの埋め込みを効率的に一致させています。この構造化された整合方法により、従来の多モーダルモデルにおけるモーダル間変換の制限を克服し、複雑なシナリオでのモデル性能を顕著に向上させています。

Ovis-U1はテキストや画像などのさまざまな入力形式を処理でき、数学的推論、物体認識、テキスト抽出、ビデオ理解などのタスクにおいて優れた性能を発揮します。例えば、画像内の物体や手書きテキストを正確に認識するだけでなく、ユーザーの指示に従って高品質な画像を生成したり、既存の画像を細かく編集することも可能です。この「三つに一体化した」能力により、教育、EC、医療、自動運転などの分野で大きな応用可能性があります。

技術の特徴: 高効率なトレーニングとオープンソース共有

Ovis-U1の開発には先進的なトレーニング戦略と多様なデータセットが活用されました。公式情報によると、このモデルはPython3.10、Torch2.4.0、Transformers4.51.3などの技術スタックを基盤として構築され、トレーニングプロセスではDeepSpeed0.15.4の最適化が採用されており、効率性と安定性を確保しています。さらに、Ovis-U1はOvisシリーズのオープンソース伝統を引き継いでおり、Apache2.0ライセンス協定に基づき、コード、モデル重み、トレーニングデータがHugging FaceとGitHubで公開されています。開発者は簡単な環境設定により、迅速に再現および配置が可能です。

AIbaseは、Ovis-U1のトレーニング中に合規性チェックアルゴリズムを導入し、モデル出力が倫理的および法的要件に適合していることを確認していることに注目しています。このような透明性のある開発方法は、アリババがオープンソースコミュニティへの貢献を示すものであり、世界中の開発者が多モーダルAIを探索するための便利なツールを提供しています。

Ovis-U1の多モーダル能力により、実際のアプリケーションで優れたパフォーマンスを発揮しています。例えば、EC分野では、Ovis-U1は商品画像を分析して多言語の説明を作成したり、ユーザーのニーズに応じて商品表示画像を編集することが可能で、消費者体験を向上させます。教育場面では、手書きの数式を識別し、詳細な解説を提供することで、学生の学習を支援します。また、Ovis-U1はレシピの生成やビデオコンテンツの分析などもサポートしており、スマートホームやコンテンツ制作のためのイノベーティブな解決策を提供します。

AIbaseは、Ovis-U1のリリースがアリババが多モーダルAI分野でのリーダーシップを強化するとともに、オープンソースモデルによってグローバルなAI技術の普及と進歩を促進すると考えています。今後、Ovis-U1はより多くの産業シーンで実装され、視覚、言語、意思決定をつなぐ知能の橋渡しとなることが期待されます。

Ovis-U1のリリース以来、SNS上で多くの議論が行われています。多くの開発者は、このモデルの多機能性とオープンソース特性に称賛を送り、中小企業や個人開発者にとって低コストのAIソリューションを提供していると評価しています。AIbaseは、Ovis-U1の広範な応用が進むにつれて、コミュニティ内で多くのイノベーティブなユースケースが登場すると予測しています。

プロジェクト:(https://huggingface.co/AIDC-AI/Ovis-U1-3B)