このたび、Qwen VLoというマルチモーダル大規模モデルが正式にリリースされました。このモデルは画像コンテンツの理解と生成において顕著な進展を遂げており、ユーザーに新しいビジュアルクリエイション体験を提供しています。

紹介によると、Qwen VLoは従来のQwen-VLシリーズモデルの優位性を引き継ぎつつ、全面的なアップグレードを行っています。このモデルは世界を正確に「理解」できるだけでなく、理解に基づいて高品質な再創作を行うことができ、本当に「感知から生成」への飛躍を実現しています。ユーザーは現在、Qwen Chat(chat.qwen.ai)プラットフォームでこの新モデルを直接体験できます。

Qwen VLoの特徴は、段階的な生成方式です。画像を生成する際には、左から右へ、上から下へと段階的に構築する戦略を採用し、予測内容を継続的に最適化調整することで、最終結果の調和と一貫性を確保します。この生成メカニズムは視覚効果を向上させ、ユーザーにより柔軟でコントロール可能なクリエイションプロセスを提供します。

コンテンツの理解と再創造に関して、Qwen VLoは強力な能力を示しています。以前のマルチモーダルモデルと比較して、Qwen VLoは生成中に語義の一貫性をよりよく保持でき、車を他の物体として誤って生成したり、元の画像の重要な構造特性を保持できなかったりする問題を回避できます。例えば、ユーザーが車の写真を入力し、色を変更するように要求した場合、Qwen VLoは車種を正確に認識し、元の構造特性を保持し、自然に色のスタイルを変換し、生成結果が期待通りでありながらも現実感を失わないようにします。

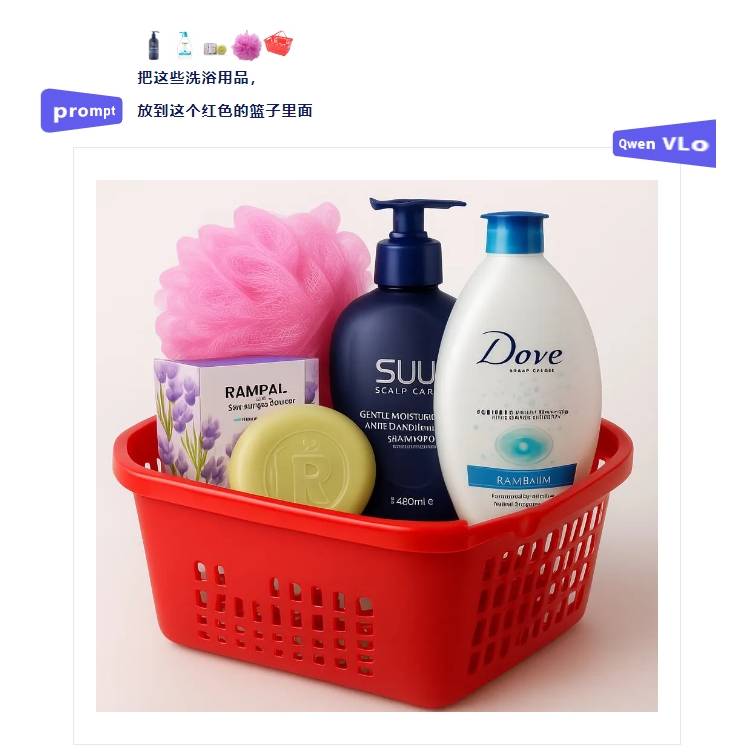

さらに、Qwen VLoはオープン命令による編集と修正をサポートしています。ユーザーは自然言語を使ってさまざまな創造的な指示を出すことができます。例えば、画風を変える、要素を追加する、背景を調整するなどです。モデルはこれらの指示に柔軟に対応し、ユーザーの期待に合った結果を生成できます。アートスタイルの移行、シーンの再構成、細部の修飾など、Qwen VLoはすべて対応可能です。

注目すべきは、Qwen VLoが多言語指令をサポートしていることです。このモデルは中国語、英語など多くの言語の指令をサポートしており、グローバルユーザーに統一的で使いやすいインタラクティブな体験を提供しています。ユーザーがどの言語を使用しても、簡単な説明で要望をモデルに迅速に理解させ、理想の結果を出力することができます。

実際の応用では、Qwen VLoは多様な機能を示しています。画像を直接生成および編集することができ、背景の交換や主体の追加、スタイル転送などが可能です。また、オープン命令に基づく大幅な編集、検出やセグメンテーションなどの視覚的知覚タスクも行えます。さらに、Qwen VLoは複数の画像の入力理解と生成、画像検出、ラベリングなどの機能もサポートしています。

テキストと画像を同時に入力する場合以外にも、Qwen VLoはテキストから画像への直接生成をサポートしています。これは一般的な画像や中英文のポスターなども含まれます。モデルは動的解像度トレーニングを使用し、任意の解像度と縦横比の画像生成をサポートしており、ユーザーが実際のニーズに応じて、さまざまなシナリオに適した画像コンテンツを生成できるようにしています。

現在、Qwen VLoはプレビュー段階にあり、すでに強力な能力を示していますが、いくつかの不備もあります。例えば、生成過程で事実に合わないまたは元の画像と完全に一致しない場合があります。開発チームは、モデルを継続的に改善し、性能と安定性をさらに向上させる予定です。

体験先:chat.qwen.ai